Eure Fragen zum KI-Betriebssystem

Wir schließen die Serie zum KI-Betriebssystem mit meinen Antworten zu euren 6 meistgestellten Fragen.

Herzlich Willkommen zu den AI FIRST Insights! Vor ein paar Tagen habe ich euch hier und auf LinkedIn gefragt, welche Fragen zum KI-Betriebssystem nach den letzten sieben Ausgaben noch offen sind. Die Antworten kamen zahlreich und zeigen gut, wo die Serie noch Lücken gelassen hat.

In diesem Newsletter beantworte ich sechs Fragen, die ich in der ein oder anderen Form immer wieder gelesen habe.

Mit dieser Ausgabe schließe ich die Betriebssystem-Serie vorerst ab. Wie es danach weitergeht, verrate ich im Fazit.

Los geht's!

“Warum der Wechsel von 25 Agenten zu KI als Betriebssystem?”

Der Auslöser war die Veröffentlichung von Claude Opus 4.6 am 5. Februar. Mit diesem Modell hat KI eine Qualität an agentischen Fähigkeiten bekommen, die es vorher in der Form nicht gab: mehrschrittiges Arbeiten über lange Zeiträume hinweg, präzises Tool-Use, eigenständige Fehlerkorrektur. Das hat uns dazu gebracht, eine grundsätzliche Frage zu stellen: Wie muss sich unsere Art und Weise ändern, wir wir KI nutzen, wenn das Modell selbst nicht mehr der Flaschenhals ist?

Um eine ehrliche Antwort darauf zu bekommen, haben wir ein Experiment gemacht. Wir haben einem einzigen Agenten Zugriff auf alles gegeben, was bei uns vorher auf viele spezialisierte Agenten verteilt war: sämtliche Anweisungen, alle Daten, alle Tools. Dann haben wir beobachtet, was passiert.

Das Ergebnis war eindeutig. Dieser eine Agent hat die Aufgaben erledigt, für die wir vorher zehn spezialisierte Agenten gebaut hatten. Er hat sich aus den vorhandenen Bausteinen jeweils genau das zusammengesucht, was er für die konkrete Aufgabe brauchte, und zwar ohne manuelles Routing, ohne hart verdrahtete Workflows und ohne Übergaben zwischen Agenten.

Meine Erkenntnis daraus war, dass es nicht mehr darum geht, möglichst viele spezialisierte Agenten zu bauen und sie wie ein kleines Team zu führen. KI kann sich selbst so konfigurieren, wie eine Aufgabe es verlangt, solange sie Zugriff auf alles hat, worauf wir Menschen auch Zugriff haben.

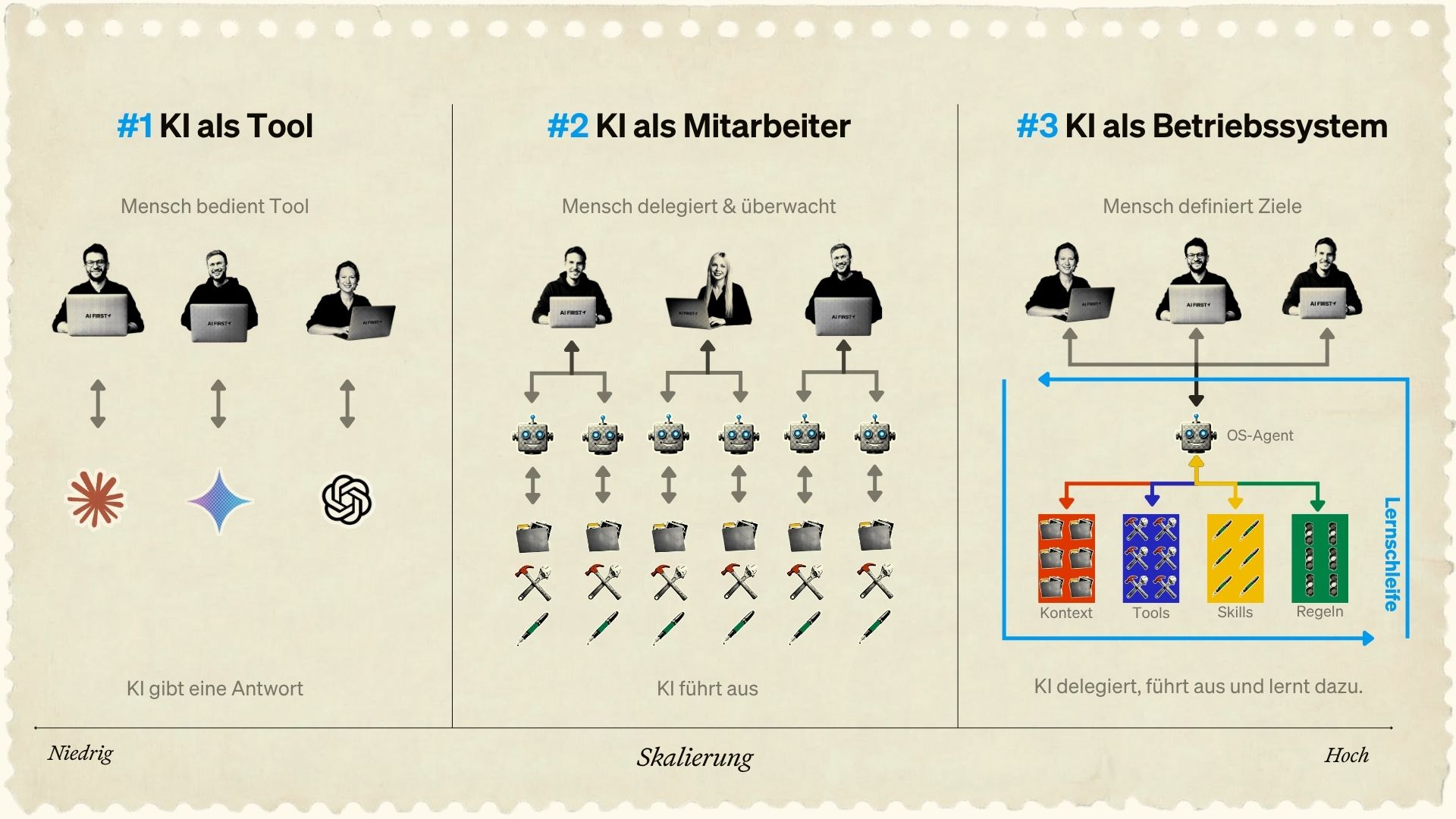

Daraus ergab sich die logische Folge. Wenn KI so arbeiten kann, dann müssen wir unser Unternehmen so umbauen, dass sie darin möglichst gut arbeiten kann. Wir haben uns noch einmal grundsätzlich gefragt, ob „KI als Mitarbeiter" oder „KI als viele einzelne Agenten und Workflows" überhaupt noch die richtige Denke ist… und sind zu der Überzeugung gekommen, dass KI als Betriebssystem in unserer Firma integriert sein muss.

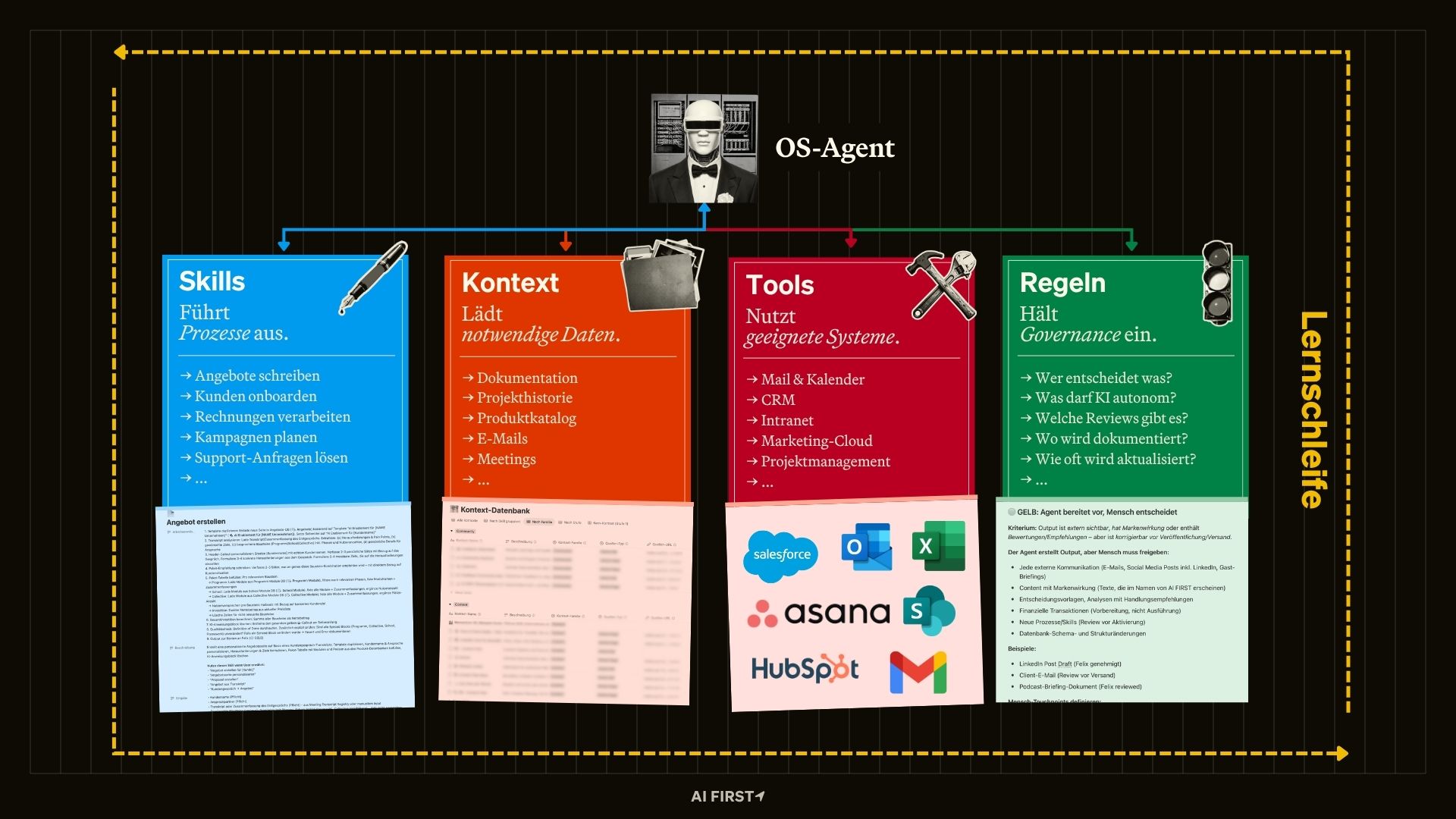

Daraus haben wir die 5 Bausteine abgeleitet, die ich in den letzten Wochen vorgestellt habe. Wir haben uns angeschaut, wie die großen AI-Labs, allen voran Anthropic, ihre eigenen Produkte weiterentwickeln. Skills, Kontext, Agenten-Pipelines, Governance und Feedback-Schleifen tauchen in einer ähnlichen Logik auch bei den Modell-Anbietern auf, und wir haben sie für unseren Unternehmenskontext adaptiert.

“Auf welchem Tech-Stack kann ich ein KI-Betriebssystem aufbauen?”

Es gibt 5 Bausteine, die du abdecken musst, egal mit welcher Plattform du arbeitest. Ich gehe sie der Reihe nach durch und schreibe jeweils dazu, welche Tools den Baustein heute schon nativ mitbringen.

1. Agent: Ausführungseinheiten auf dem System

Der Agent konfiguriert sich für jede Aufgabe so, wie es zur Erledigung notwendig ist. Er nimmt Aufgaben entgegen, sucht sich den passenden Skill, lädt den nötigen Kontext und führt die Arbeit aus. Entscheidend dabei ist, dass die Anweisung des Agents konfigurierbar sein muss. Der Systemprompt mit Rolle im OS, Zugriffe auf Kontext und Tools ist das Herzstück. Ohne präzise Konfiguration wird selbst das beste Modell zum Generalisten ohne Tiefe. Zugriff auf ein leistungsfähiges Frontier-Modell wie Opus 4.6 oder besser ist ein MUSS.

2. Kontext: die zentrale Datenbasis.

Das ist einer der wichtigsten Bausteine. Idealerweise ein System, in dem alle relevanten Daten zusammenfließen: erst einmal das Wissen des Unternehmens (Prozesse, Richtlinien, Kundendaten, Produkte), später auch operative Daten. Der eigentliche Sprung kommt, wenn der Agent nicht nur lesen, sondern auch in diese zentrale Basis zurückschreiben kann. Dann wird das System selbstpflegend. Das Wissen selbst kann in Notion, Confluence oder SharePoint liegen - entscheidend ist nicht das Tool, sondern dass der Agent strukturiert zugreifen und perspektivisch auch zurückschreiben kann. Außerdem sind Schnittstellen in Drittsysteme notwendig, aus denen Daten gezogen oder in die Daten geschrieben werden müssen (Mail, Kalender, CRM, …).

3. Skills: SOPs für Agenten.

Skills sind die dokumentierten Fähigkeiten deiner Organisation. Sie beschreiben, wie eine Aufgabe auszuführen ist, inklusive Kontext, Regeln und Qualitätskriterien. Es gibt zwei Wege, das umzusetzen: als eingebaute Skill-Funktion einer Plattform (Claude macht das gerade vor, auch Langdock geht in diese Richtung) oder als eigene Datenbank, in der Prozesse strukturiert hinterlegt sind und auf die der Agent zugreift. Bei uns liegen die Skills in Notion, weil dort auch das Wissen lebt.

4. Regeln: systemisch integriert.

Governance kann als Dokument in der zentralen Datenbasis leben oder als Markdown-Datei, die der Agent bei jeder relevanten Ausführung mitliest. Entscheidend ist, dass Governance nicht nur nebenher läuft, sondern auch fest ins System eingebaut ist - zum Beispiel über Human-in-the-Loop Freigaben.

5. Feedback-Mechanismus.

Das System muss lernen können. Bei uns ist das eine eigene Feedback-Datenbank, in die Learnings aus jeder Ausführung einfließen, gekoppelt an eine automatische Verbesserung der Skills. Dieser Baustein ist in den Plattformen noch am wenigsten reif. Wir haben ihn selbst gebaut, als Kombination aus Notion-Datenbank und einem Agenten, der die Einträge regelmäßig auswertet und in Skill-Updates übersetzt.

Welche Plattformen decken das heute schon gut ab?

Ein vollumfängliches und anpassbares KI-Betriebssystem kann meiner Meinung nach zum jetzigen Zeitpunkt nur in Notion und über Claude Code + Github-Repositories umgesetzt werden. In beiden Setups können alle Bausteine individuell konfiguriert und systemisch miteinander verbunden werden. Die KI sitzt außerdem direkt auf den Daten und kann diese einfach verarbeiten und die Datenbasis fortlaufend aktualisieren. Claude Code ist im Setup deutlich technischer und für größere, nicht-technische Teams ungeeignet.

Da 99% der Unternehmen da draußen kein Claude Code oder Notion einführen werden, haben wir uns in den letzten Monaten viele Alternativen angeschaut und geprüft, wie sich unsere Logiken in bestehenden Systemen umsetzen lassen.

Ein Weg, den wir aktuell mit vielen Kunden umsetzen, ist eine Kombination aus Langdock/Claude + externe Datenbanken und Tools.

- In Langdock/Claude lebt der OS-Agent, die Agenten-Pipeline, die Skills und Tool-Anbindungen.

- In Sharepoint/Confluence/Drive/… lebt der Kontext-Layer mit Wissen und Dokumentationen, das Governance-Handbuch, sowie die Feedback-Datenbank.

- In angebundenen Drittsystemen (CRM, ERP, PM, …) können Aktionen ausgeführt werden.

Auch andere Anbieter wie nuwacom entwickeln ihre Plattform in die Richtung, um KI als Betriebssystem aufsetzen zu können. Ich bin mir ebenfalls sicher, dass auch Google und Microsoft in diese Richtung arbeiten, da sie bereits einen guten Zugang zu den Daten in ihrem Ökosystem haben. Besonders mit den Möglichkeiten im Copilot-Setup haben wir uns viel beschäftigt, sind aber zu keiner halbwegs zufrieden stellenden Lösung gekommen.

“Sind die Tools nicht selbst schon das Betriebssystem?”

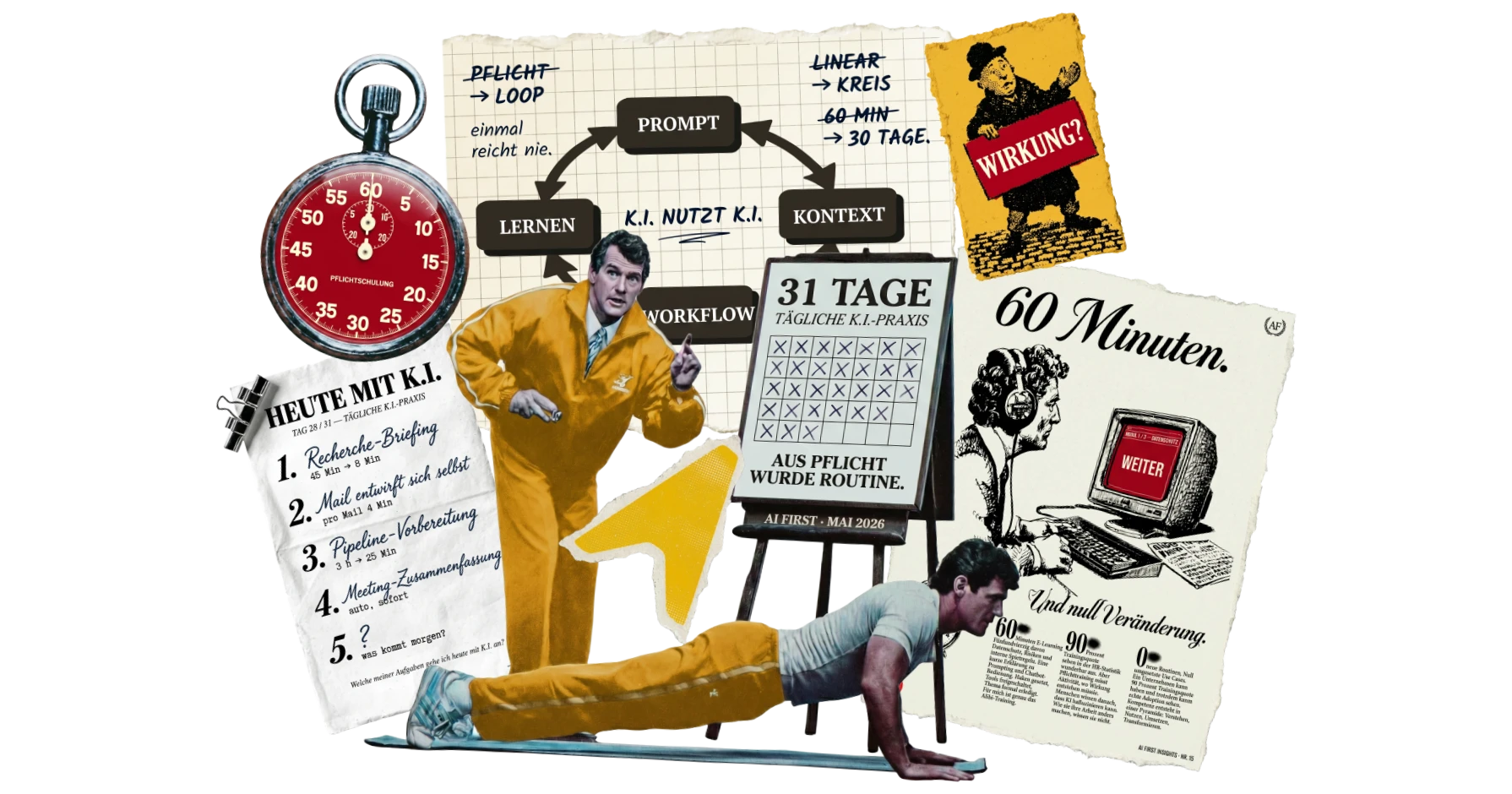

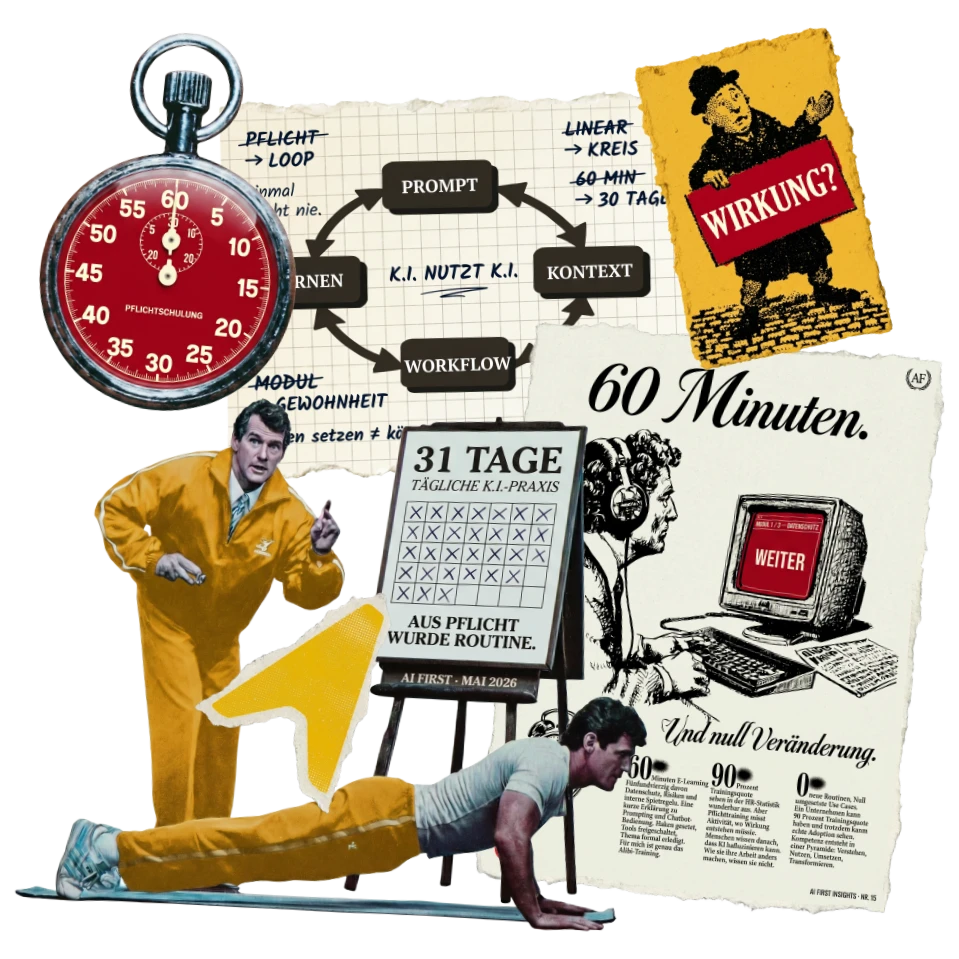

Jein. KI als Betriebssystem zu denken ist eher ein Framework. Wir betrachten KI nicht mehr als Tool, das eine Funktion erfüllt, und auch nicht mehr als Mitarbeiter mit einer festen Rolle. Wir betrachten sie als die operative Grundlage unserer Arbeit. Die Tools auf denen wir dieses Framework umsetzen, geben zum Teil eine Struktur vor - Agenten, Skills, Integrationen.

Wie diese Funktionen zusammenarbeiten und was sie ausführen, muss von uns kommen.

Dafür benötigen wir einen Mindset-Shift: Das Unternehmen so umzubauen, dass KI darin möglichst gut arbeiten kann. Wir geben KI die Struktur, in der sie auf alles Zugriff hat, worauf auch wir Menschen Zugriff haben, damit sie einen Großteil unserer Arbeit selbst erledigen oder uns dabei stark unterstützen kann. Und genau diese Struktur setzen wir in den Bausteinen des Betriebssystems um (Skills, Kontext, Regeln, Integrationen, …)

Die Tools liefern die notwendigen Funktionen dafür. Die größte Wirkung entsteht aus den systemischen Designprinzipien, mit denen wir diese Funktionen zusammenbringen - Vernetzung, Synthese, Emergenz, Rückkopplung, Kausalität. Erst diese Prinzipien ermöglichen, dass die einzelnen Bausteine wirklich als System zusammenarbeiten und nicht nur nebeneinanderher laufen.

Am Ende lebt das System von den Inhalten, die wir hineingeben, und von der Art, wie wir damit arbeiten. Auf die Anwendung kommt es viel mehr an als auf die Plattform.

“Wie habt ihr das Wissen und die Prozesse ins System gebracht?”

Wir sind das nicht über ein großes, klassisch aufgesetztes Dokumentationsprojekt angegangen, sondern in einer Sequenz, in der die KI selbst so viel wie möglich übernimmt.

Unser Prozess sah grob so aus:

- Angefangen haben wir mit den Kontextprofilen. Jeder bei uns hat sich von der KI interviewen lassen, 60 Minuten, Block für Block. Daraus sind pro Person fünf Dokumente entstanden: Firmenprofil, Rollenprofil, Team-Kontext, Prioritäten und Kommunikationsstil. Das war der Grundstock, aus dem sich viele weitere Fragen ableiten ließen.

- Auf Basis dieser Profile lässt sich KI hervorragend nutzen, um zu destillieren, welche Aufgaben und Prozesse im Alltag tatsächlich anfallen. Wir haben das angereichert mit allem, was wir intern schon dokumentiert hatten, und bekamen so eine erste Landkarte der Prozesse im Unternehmen.

- Im nächsten Schritt haben wir für jeden relevanten Prozess Interviews geführt, wieder KI-gestützt. Das Ziel war, Prozesswissen und implizites Fachwissen aus den Köpfen zu holen und so maschinenlesbar aufzubereiten, dass die KI den Prozess danach eigenständig ausführen kann. Die maschinenlesbare Aufbereitung der Interviews hat ebenfalls eine KI gemacht. So ist Schritt-für-Schritt unsere Skill-Datenbank und die Kontext-Datenbank gewachsen.

Heute ist das ein fortlaufender Prozess. Wissen verändert sich, Kontext verändert sich, Prozesse entwickeln sich weiter. All das muss laufend ins System zurückfließen. Eine einmalige Aufsatz-Arbeit, die man irgendwann als „fertig" markiert, gibt es hier nicht. Das System lebt nur, wenn es jeden Tag gepflegt und weitergedacht wird. Deshalb haben wir inzwischen auch eine feste Vollzeit-Rolle bei AI FIRST, die genau das macht - das Betriebssystem täglich weiterentwickeln.

“Wie integriere ich das in einem größeren Team oder Unternehmen?”

Wichtig ist zum Start, dass überhaupt die Infrastruktur vorhanden ist, um KI als Betriebssystem aufsetzen zu können. Es braucht also einen modernen KI- und Daten-Stack (siehe oben). Außerdem benötigen wir natürlich großen organisatorischen Support, denn jetzt beginnt ein Change-Prozess.

Wenn diese Grundlage gegeben ist, gehen wir wie folgt vor:

- Auswahl eines Teams/einer Abteilung mit der höchsten Reife (Prozesse, Datenqualität, Veränderungsbereitschaft, digitales Know-How)

- KI-Kompetenzaufbau: Sicheren Umgang mit KI lernen und deren Fähigkeiten verstehen

- Kontext- und Prozess-Mapping: Überblick über die Prozesse und Datenquellen gewinnen

- Priorisierung der Kontext-Quellen und Prozesse, die in das Betriebssystem überführt werden sollen

- Schrittweise Erstellung von Skills und Anbindung der erforderlichen Kontext-Quellen

- Überführung vorhandener Agents in Skills, die vom OS-Agent ausgeführt werden können

- Fortlaufendes Monitoring der Feedbacks durch den Owner des KI-Betriebssystems

Im Grunde genommen ist der Prozess nicht so viel anders, als wenn ich einen Fachbereich in der KI-Anwendung schule, dann Use Cases erarbeite, diese Use Cases umsetze und in die Anwendung im Alltag bringe. Nur dass wir jetzt einen systemischen Ansatz haben, durch den wir die Prozesse als Skills von KI ausführbar machen und immer mit dem notwendigen Kontext verbinden. So profitiert das gesamte Unternehmen von der Erweiterung des Betriebssystems.

Der häufigste Fehler, den wir sehen, ist das die 100% Lösung von Beginn an gesucht wird.

Unternehmen versuchen, das von einem Tag auf den anderen über alle Bereiche gleichzeitig auszurollen. Alle sollen auf einmal in die neue Logik kommen. Das ist massiv überfordernd, für die Menschen, für die IT und für die Governance, und endet in fast allen Fällen in Lähmung statt in Fortschritt. Besser ist es, klein anzufangen, die Wirkung im ersten Bereich zu zeigen, Vertrauen aufzubauen und von dort aus weiter auszurollen.

“Was würdet ihr heute anders machen?”

Einen Punkt ganz klar: viel, viel mehr Fokus auf Prozess- und Datenqualität.

Alles explizit zu machen und für KI zugänglich zu machen, ist am Ende das A und O. Die Qualität des Systems wird genau dadurch entschieden, wie sauber die Prozesse dokumentiert sind, wie gut strukturiert der Kontext ist, wie aktuell die Daten sind. Das entscheidet am Ende zwischen einem Betriebssystem, das wirklich trägt, und einem, das nach drei Wochen wieder liegen bleibt, weil die Ergebnisse nicht konsistent genug sind.

Wir haben am Anfang zu viel Energie in clevere Agenten-Logik und zu wenig in saubere Grundlagen gesteckt. Heute würde ich die Reihenfolge umdrehen und zuerst an Kontext, Prozessqualität und maschinenlesbarer Dokumentation arbeiten. Die agentische Logik setzt man am besten darauf und ist am Ende auch der leichte Teil.

Eine weitere Herausforderung ist die eigene Verhaltensänderung. Wenn das System einmal greift, wird immer mehr Zeit freigesetzt, weil KI einen immer größeren Anteil der Arbeit beschleunigt oder direkt erledigt. Sich von den alten Arbeitsroutinen zu lösen und die gewonnene Zeit sinnvoll einzusetzen, ist leichter gesagt als getan. Auch ich ertappe mich täglich dabei, wie ich Dinge tue, die ich eigentlich nicht mehr tun muss.

Fazit

Abschließend möchte ich dir mitgeben, dass es nicht die eine Lösung oder den einen Weg gibt.

KI als Betriebssystem zu denken und im Unternehmen umzusetzen, kann auf unterschiedliche Arten und Weisen gelingen. Unsere Logiken bieten ein gute Basis und können natürlich weiterentwickelt und angepasst werden.

Parallel entwickeln sich sowohl die großen KI-Plattformen, als auch die Systeme in denen heute unsere Daten liegen, weiter. Was wir uns in den letzten Monaten aufwändig zusammengebaut haben, wir in Zukunft technisch eher einfacher werden. Die Technik wird jedoch nicht der Flaschenhals sein. Prozess-Verständnis, Daten-Qualität und der Veränderungsmuskel in der Organisation sind der Schlüssel zum Erfolg.

Am Ende geht es immer um die Umsetzung. Die meisten Teams werden weiter mit KI-Tools hin- und her prompten oder versuchen ihre dutzenden KI-Agenten zu koordinieren. Nur ein kleiner Teil wird KI konsequent systemisch im Unternehmen verankern und darüber Produktivitätsvorteile sichern.

Die Umsetzungs- und Anwendungsweltmeister werden gewinnen.

Für die nächsten Wochen habe ich mir vorgenommen, ein paar handfeste KI-Routinen zu teilen, die ich mir in letzter Zeit angeeignet habe und einen Einblick in die erfolgreichsten Ansätze für KI-Adaption zu geben, die wir bei Kunden umgesetzt haben.

Bleibt gespannt und bis nächsten Sonntag,

Felix

P.S. Im Collective bauen wir das KI-Betriebssystem gerade mit über 100 Führungskräften gemeinsam auf. Das Collective ist aktuell für neue Mitglieder geschlossen und wir nehmen zum 01. Juli max. 30 neue Teilnehmer auf, die ihr Unternehmen fit für das KI-Zeitalter machen wollen. Wenn Du dabei sein willst, trage dich hier auf der Warteliste ein.

Registriere dich kostenlos,

um den vollständigen Artikel zu lesen.

vollständige Insights

Hub-Werkzeugen

und diskutiere mit

an einem Ort