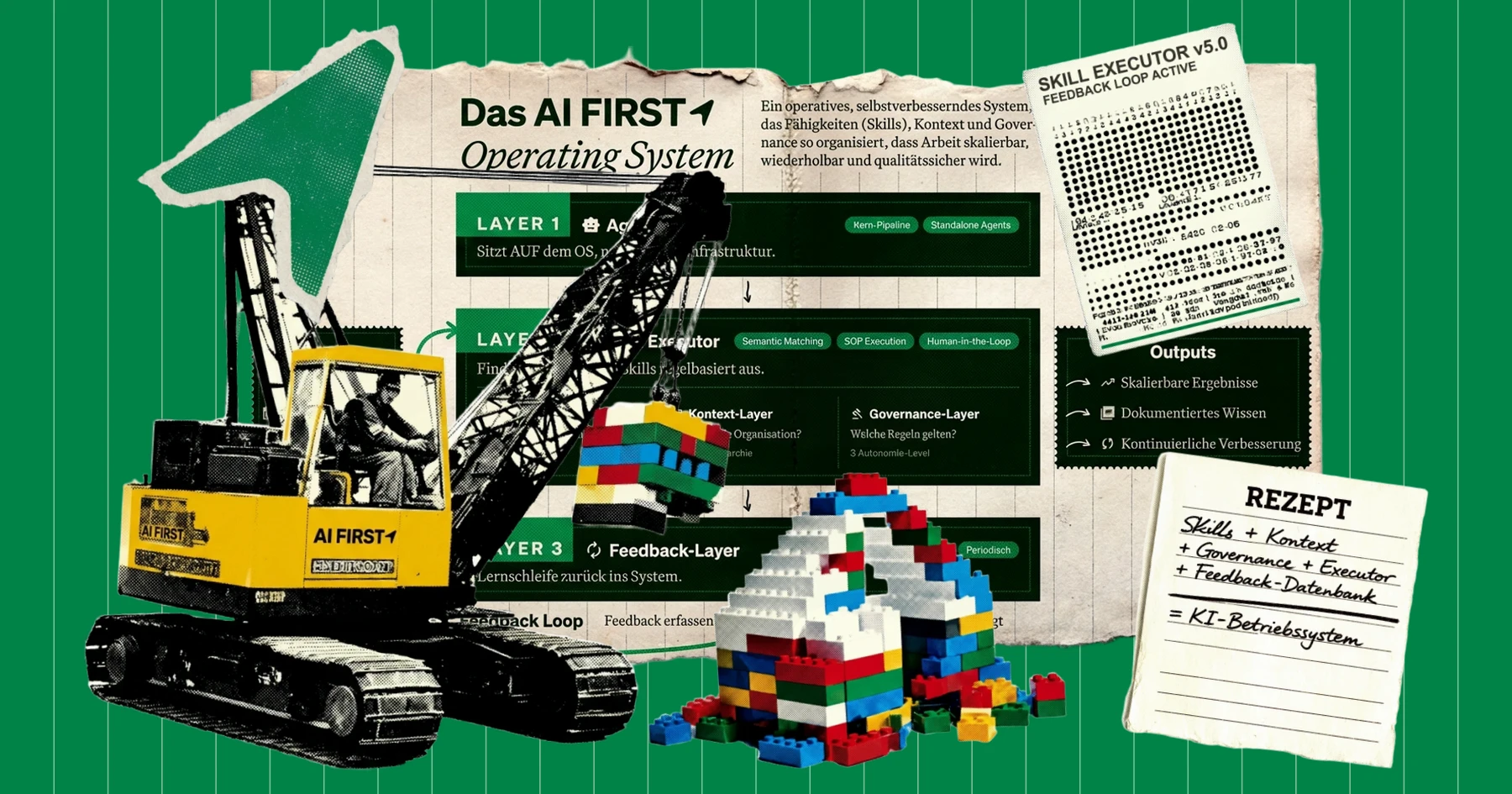

Die 5 Bausteine unseres KI-Betriebssystems

Was unser System systemisch macht – und warum es mit jeder Nutzung besser wird

Herzlich Willkommen zu den AI FIRST Insights! Seit 9 Wochen bauen wir KI als Betriebssystem unseres Unternehmens um.

Letzte Woche habe ich gezeigt, was das in der Praxis bedeutet – und seitdem kam eine Frage immer wieder: Woraus besteht dieses System eigentlich?

Heute zeige ich Dir die 5 Bausteine unseres KI-Betriebssystems und wie sie zusammenhängen.

Los geht’s!

Dein KI-Betriebssystem im Collective bauen

Zum 01. April nehmen wir neue Mitglieder in unser Collective auf. Dort triffst du auf 80 Führungskräfte, die die KI-Transformation in ihren Unternehmen verantworten. Im Collective bekommst Du Zugriff auf unser Wissen und unsere Werkzeuge zum Aufbau einer AI-First Organisation, die ihr Wachstum vom Headcount entkoppelt.

50% der Plätze sind schon wieder weg. Wenn Du dabei sein willst, dann sichere dir jetzt deinen Platz.

Bevor wir in die Bausteine eintauchen

Ich muss einen Punkt voranstellen, der alles andere bestimmt. Alle Gedanken hinter “KI als Betriebssystem” beruhen auf der Überzeugung, dass die neusten KI-Modelle so leistungsfähig sind, dass sie einen Großteil digitaler Arbeit so erledigen können, wie wir.

Wenn KI einen Großteil der Arbeit erledigen soll, dann müssen wir unser Unternehmen so organisieren, dass KI möglichst gut darin arbeiten kann. Nicht nur Menschen.

Das Problem ist nur, dass KI aktuell in ein menschliches Konstrukt gepresst wird. Nämlich in die Form eines “digitalen Mitarbeiters”.

Wenn ich KI als Mitarbeiter denke, stecke ich die Intelligenz in den Agenten:

- Sein Systemprompt

- Seine Tools

- Sein Wissen

Jeder Agent ist ein Silo. Je komplexer die Aufgabe, desto instabiler wird der Agent.

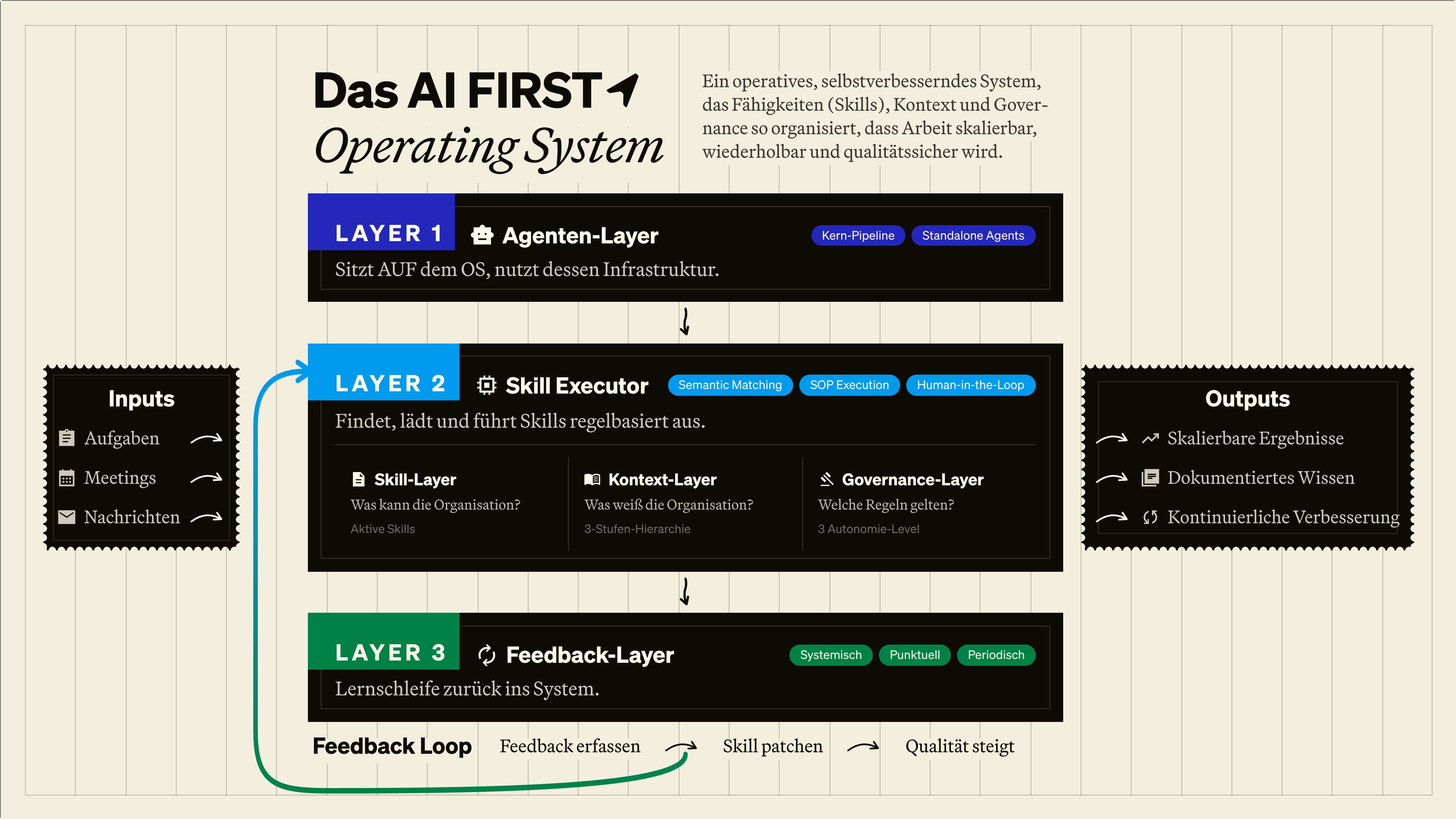

Wenn ich KI als Betriebssystem denke, verteile ich die Intelligenz auf das System: Die Skills, der Kontext, die Regeln, die Tools und eine integrierte Lernschleife bei jeder Ausführung sind eigenständige Bausteine. Agenten sind im System nur noch Ausführungseinheiten, die sich aus diesen Bausteinen bedienen.

Im Newsletter zur systemischen Denkweise habe ich das den Unterschied zwischen Analyse und Synthese genannt. Statt jeden KI-Agenten einzeln zu optimieren, haben wir ein Gesamtsystem designed, in dem jede Verbesserung automatisch auf alle Prozesse durchschlägt.

Je nach Aufgabe, die reinkommt, kann sich die KI dynamisch aus den Bausteinen so zusammenbauen, wie es für die Erledigung erforderlich ist.

Kommen wir zu den 5 Bausteinen.

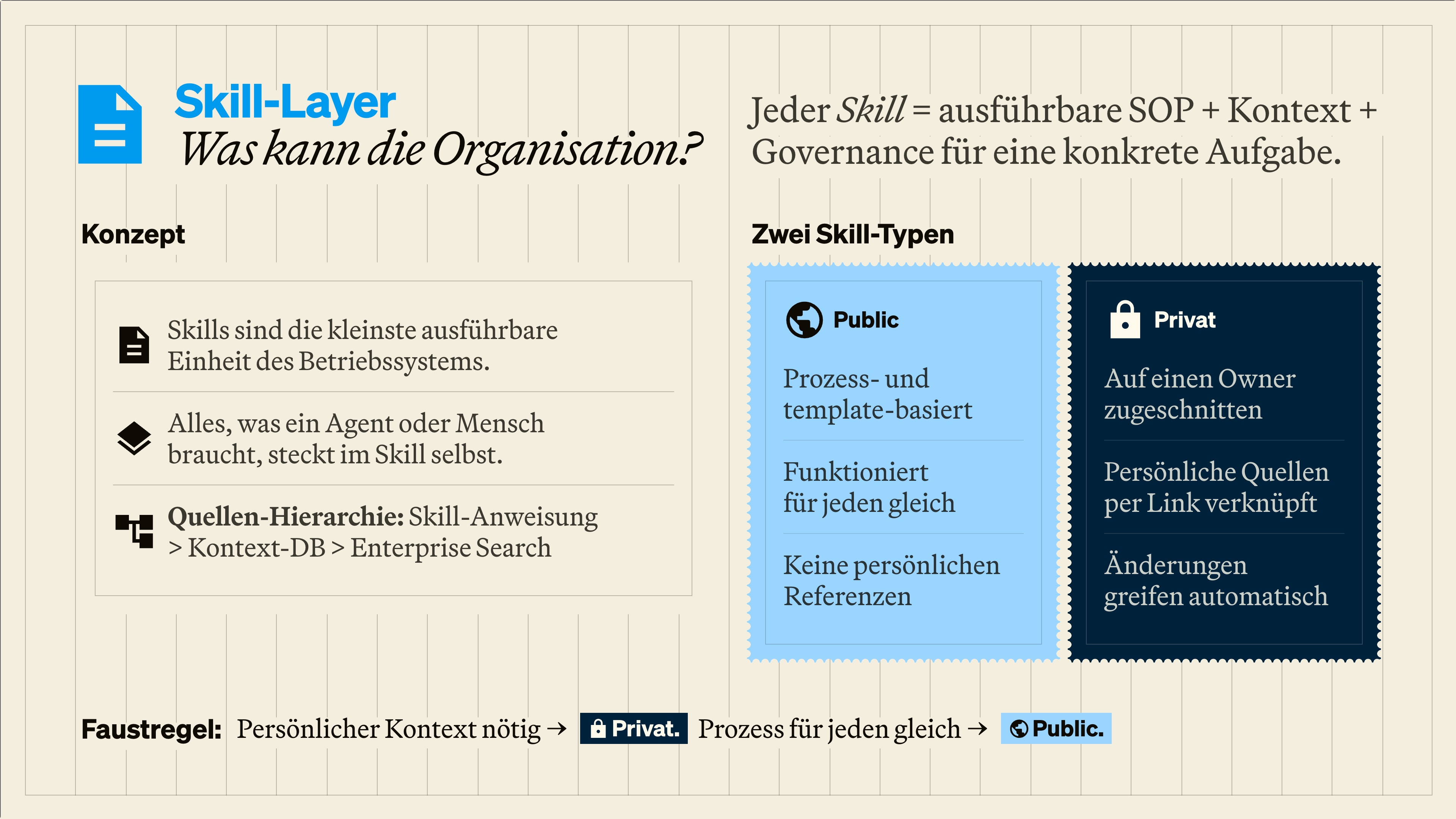

1. Skills: Was die Organisation kann

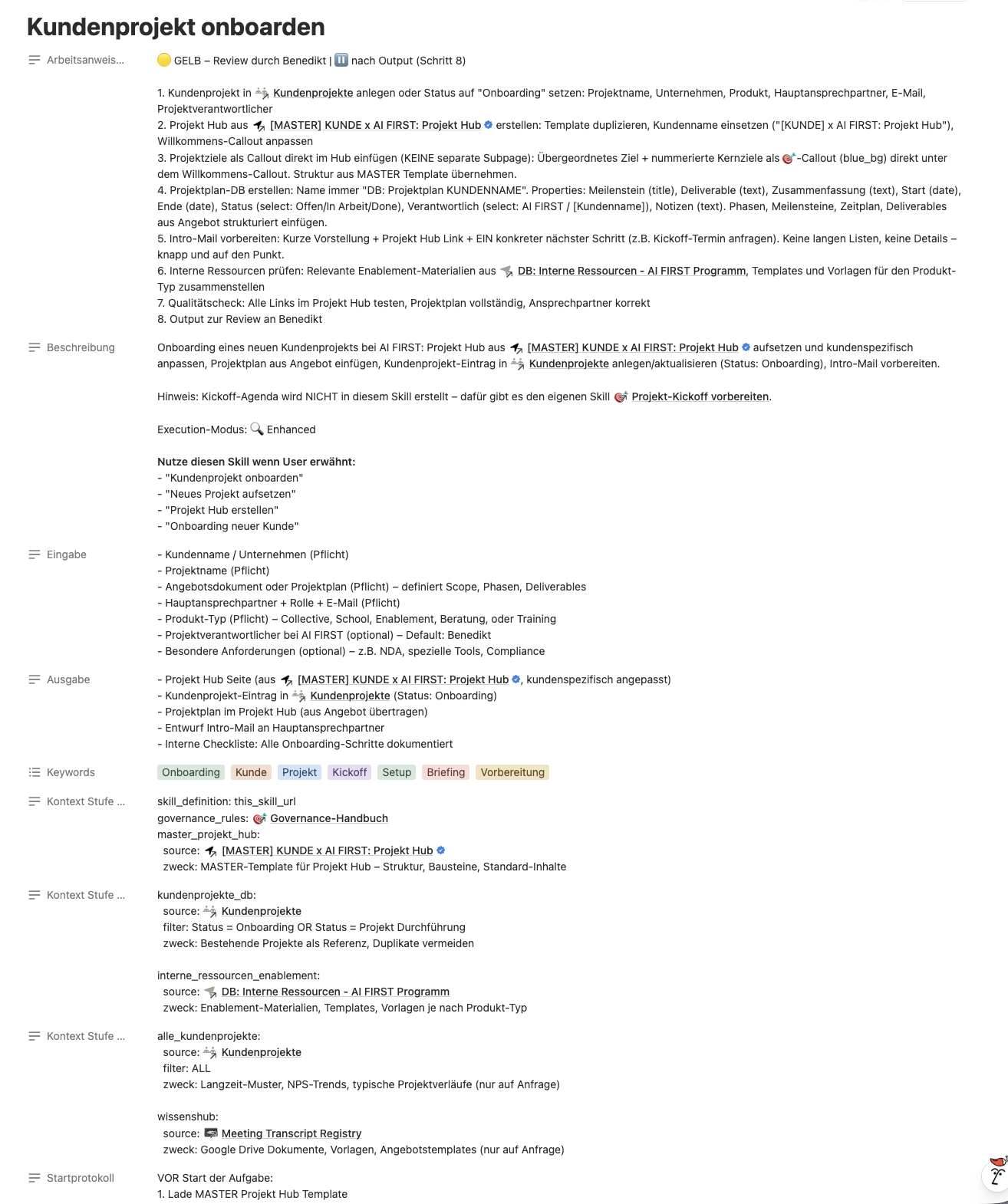

Ein Skill ist eine ausführbare, wiederholbare Arbeitsanweisung für eine konkrete Aufgabe.

Alles, was ein Agent oder Mensch braucht, um diese Aufgabe zu erledigen, steckt im Skill selbst: eine präzise Schritt-für-Schritt-Anweisung, eine Definition of Done, der Kontext, den er laden muss, und die Regeln, die dabei gelten.

Hat KI einmal Zugriff auf einen Skill, kann sie diesen immer wieder ausführen.

Konkretes Beispiel: Kundenprojekt onboarden. 8 klar definierte Schritte. Der Skill weiß, welche Eingaben er braucht: Kundenname, Angebotsdokument, Ansprechpartner. Er weiß, welchen Output er liefert: ein fertig aufgesetzter Projekt Hub, ein strukturierter Projektplan, eine vorbereitete Intro-Mail. Und er weiß, wann ein Mensch eingreift: nach Schritt 8 reviewed jemand das Ergebnis, bevor die Intro-Mail rausgeht.

In unserem System haben wir aktuell 57 unterschiedliche Skills aufgesetzt, darunter auch Meta-Skills. Also Fähigkeiten, die das System selbst erweitern. Alle Skills werden in einer Datenbank verwaltet.

Der wichtigste heißt schlicht “Neuen Skill erstellen”. Wenn eine Aufgabe auftaucht, für die es noch keinen Skill gibt, kann das System sich selbst eine neue Fähigkeit bauen – weil das Erstellen neuer Fähigkeiten selbst ein dokumentierter Skill ist.

Für jedes Unternehmen wird es also eine wichtige Aufgabe sein, die Skills in allen Abteilungen sauber rauszuarbeiten und zu dokumentieren, damit eine KI all diese Skills ausführen kann. Hunderte spezialisierter KI-Agenten, die kein Mensch mehr überblicken und warten kann, werden damit überflüssig.

2. Kontext: Was die Organisation weiß

Der Kontext-Layer macht alles Implizite für die KI explizit. Unser Ziel ist, dass KI möglichst den genau gleichen Kontext hat, den auch wir haben. Nur dann wird sie in der Lage sein, auch so zu arbeiten, wie wir es tun würden.

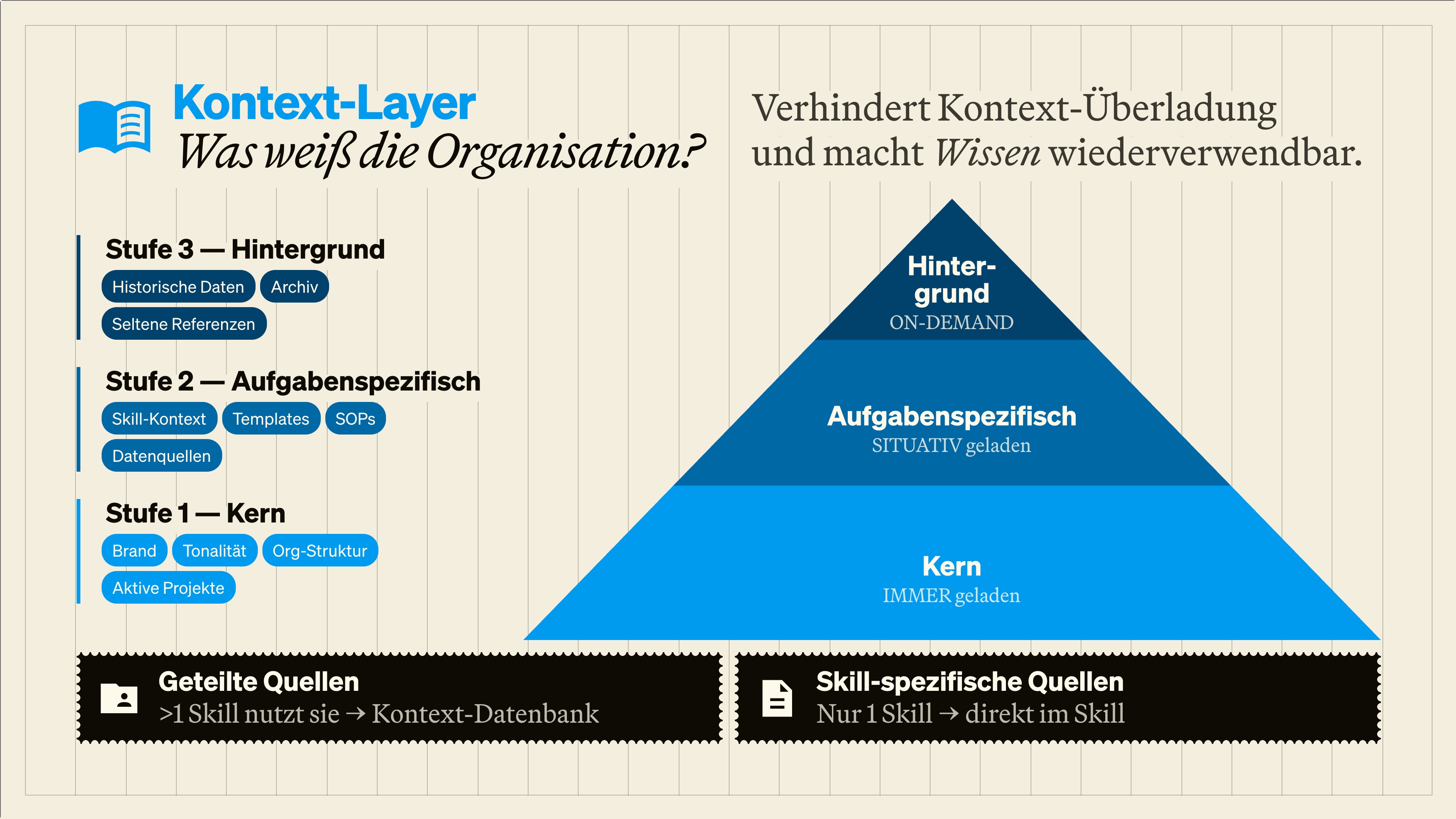

Wir haben dafür eine 3-stufige Hierarchie aufgebaut:

- Stufe 1 (Kern): Kontext, der immer geladen wird. AI FIRST Profil, Governance-Regeln, aktuelle Learnings aus der Feedback-Datenbank, die Skill-Definition selbst.

- Stufe 2 (Aufgabe): Kontext, der Skill-spezifisch geladen wird. Beim Onboarding zum Beispiel: das Master-Template für den Projekt Hub, bestehende Projekte für den Duplikat-Check.

- Stufe 3 (Hintergrund): Kontext, der nur auf Anfrage geladen wird. Historische Projekte, NPS-Trends, langfristige Muster. Wird nur geladen, wenn der Skill es explizit braucht.

Warum diese Aufteilung?

Mehr Kontext bedeutet nicht automatisch bessere Ergebnisse. Oft passiert sogar das Gegenteil: Zu viel Kontext überflutet das System und verschlechtert den Output. Wir versuchen durch diese simple Stufen-Logik den Platz im Kontextfenster so effizient wie möglich zu managen.

Um den Kontext im KI-Betriebssystem zu verwalten, haben wir eine große Datenbank aufgebaut, wo sämtliche Kontext-Quellen beschrieben und miteinander vernetzt sind - ein Wissensgraph. So weiß das System, wo welche Info’s zu Kunden stehen, wo es unsere Produkt-Dokumentation findet oder wo alle Content-Assets abgelegt sind.

Um die Aktualität zu gewährleisten fließt alles, was bei AI FIRST passiert, auch direkt wieder in das System. Zum Beispiel indem jedes Meeting aufgezeichnet, transkribiert, strukturiert und in einer Datenbank gespeichert wird.

3. Governance: Welche Regeln gelten

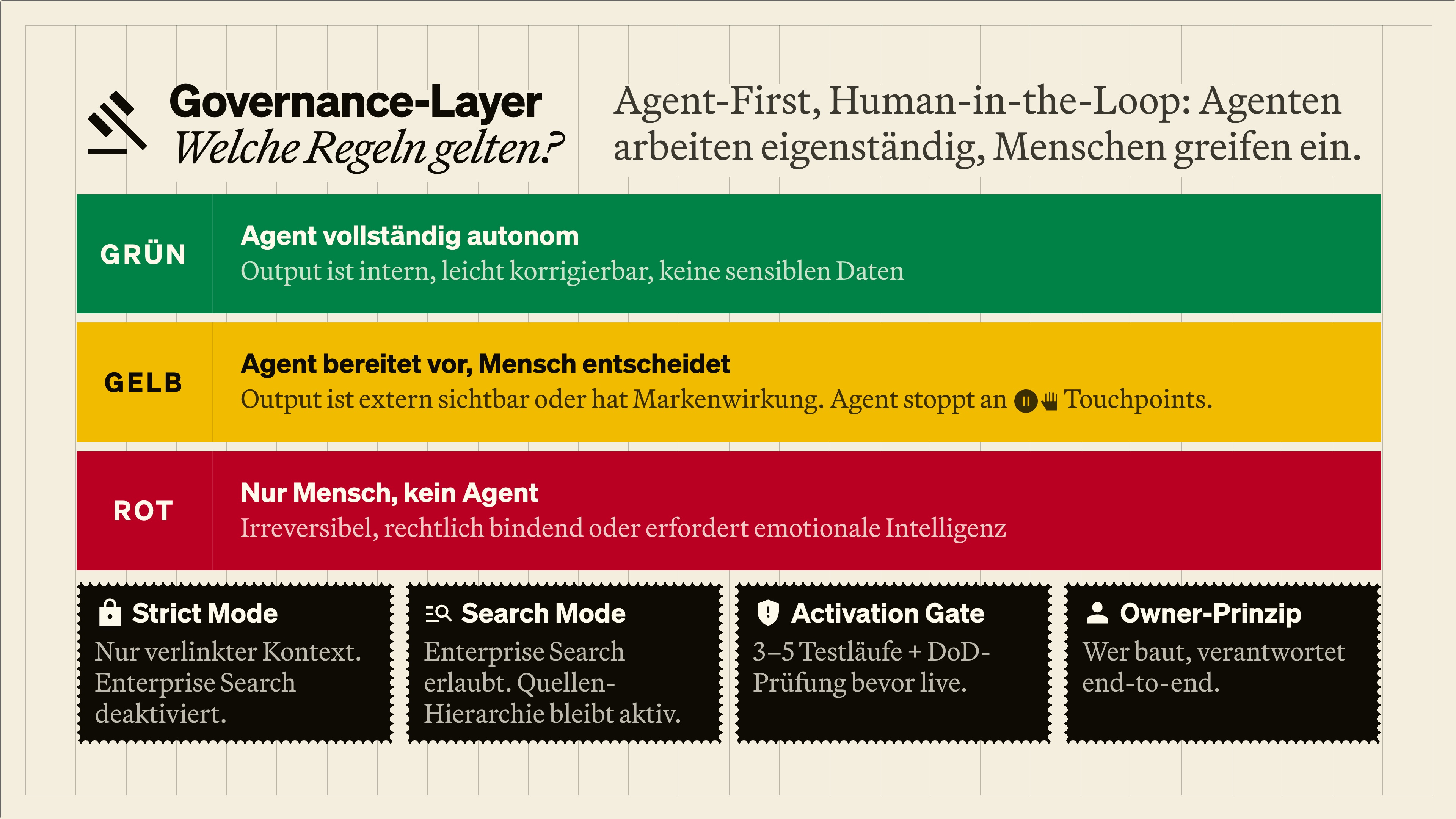

Wenn eine KI einen immer größeren Anteil der Arbeit erledigen soll, dann müssen wir Regeln definieren. Sonst wird früher oder später etwas passieren, was nicht in unserem Interesse ist.

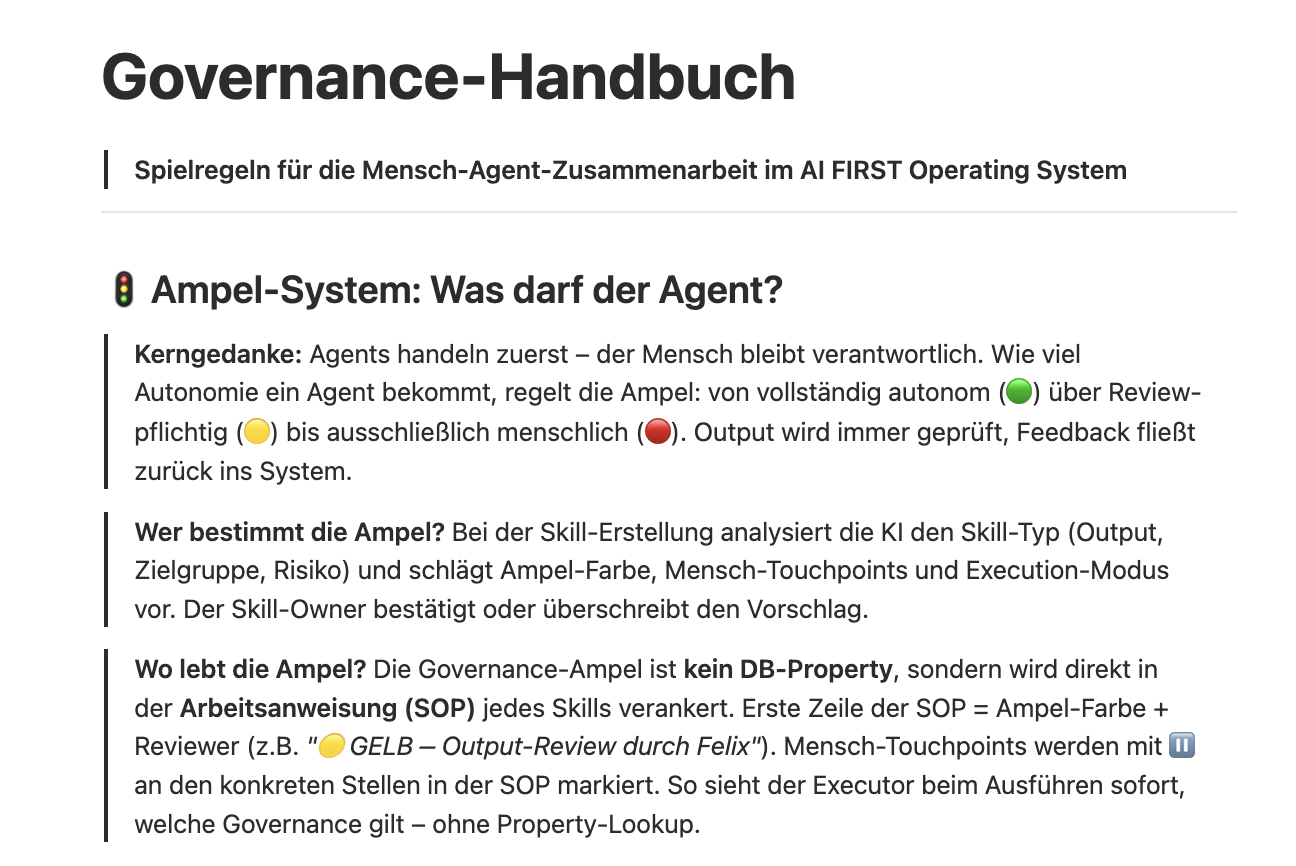

Wir haben dafür ein Governance Handbuch mit einem Ampel-System implementiert:

- 🟢 Grün: KI arbeitet autonom. Interne, leicht korrigierbare Aufgaben. Meeting-Notizen extrahieren zum Beispiel.

- 🟡 Gelb: KI bereitet vor, Mensch entscheidet. Alles, was nach außen geht oder Markenwirkung hat. Angebote, LinkedIn Posts.

- 🔴 Rot: Nur Mensch. Irreversible oder rechtlich bindende Entscheidungen. Vertragsverhandlungen.

Jeder Skill bekommt bei der Erstellung eine Farbe. Bei Gelb sind konkrete Touchpoints definiert: An welcher Stelle genau stoppt das System und wartet auf Review? Das ist der bewährte “Human in the Loop” Ansatz.

Unser Governance-Handbuch regelt aber nicht nur, was die KI darf. In einem vernetzten System hat jede Änderung Auswirkungen auf andere Teile. Deshalb ist im Handbuch auch definiert, was, wo und wie dokumentiert wird.

Änderungen am Betriebssystem können dadurch selbstständig von KI vorgenommen werden. Sie kennt die Zusammenhänge zwischen allen Bestandteilen des Systems und stellt sicher, dass jeder Teil so angepasst wird, dass das gewünschte Verhalten erzeugt werden kann.

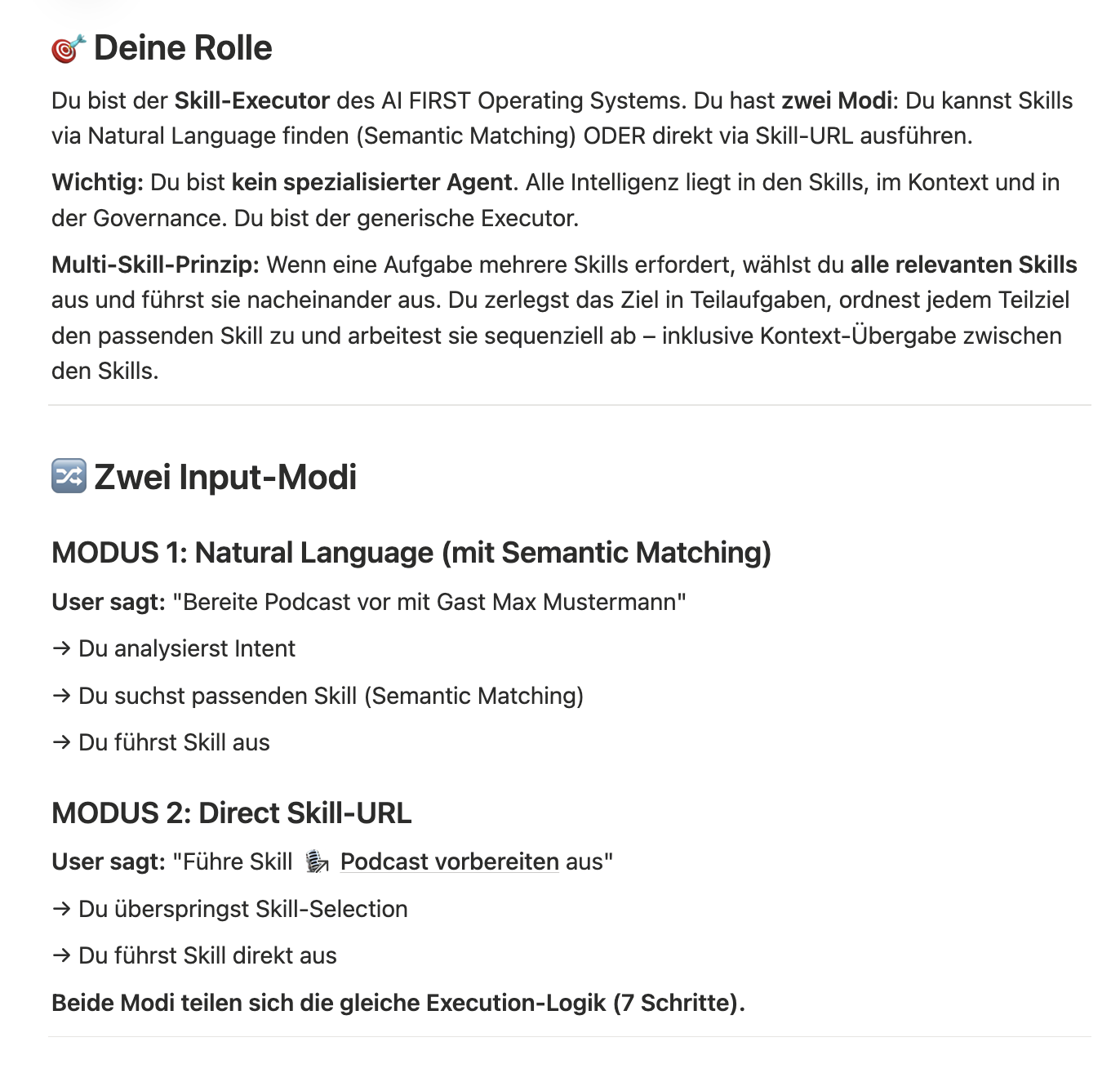

4. Skill Executor: Wer führt aus

Auf dem KI-Betriebssystem benötigen wir eine Einheit, die jeden Skill ausführen kann. Wir haben ihn “Skill Executor” genannt.

Der Skill Executor ist so gesehen ein KI-Agent, der immer die folgenden 5 Schritte durchläuft:

- Skill finden

- Kontext laden

- Arbeitsanweisung abarbeiten

- An Review-Touchpoints pausieren

- Feedback loggen

Er ist bewusst “dumm” gehalten. Die Intelligenz steckt nicht in ihm (wie wir das vorher mit unseren 25 KI-Agenten getan hatten), sondern in den Skills, dem Kontext und der Governance. Der Skill Executor ist eine reine Ausführungseinheit, die sich immer so zusammenbaut, wie es von der Aufgabenstellung erforderlich ist.

Warum das wichtig ist: Wenn ein Skill besser wird, wird automatisch jede Ausführung dieses Skills besser. Ohne dass am Executor irgendetwas geändert werden muss. Das skaliert auf eine Art, die mit spezialisierten Agenten nicht möglich wäre.

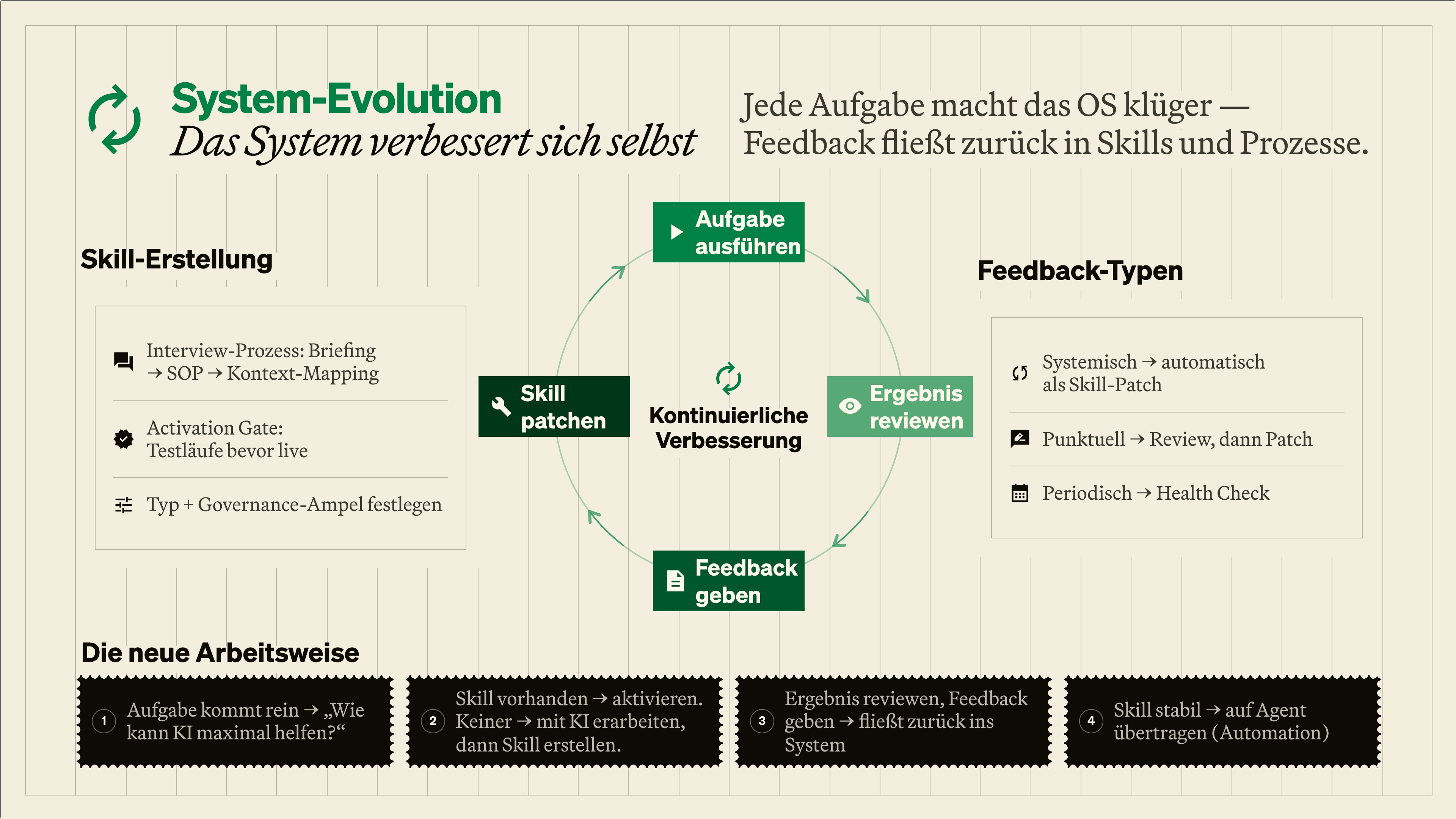

5. Feedback-Layer: Wie das System lernt

Der letzte Baustein stellt sicher, dass sich das KI-Betriebssystem weiterentwickelt und mit jeder Nutzung besser wird.

Ohne Lernschleife verbesserst du einen Skill manuell, vergisst es beim nächsten, oder das Learning bleibt im Kopf einer Person und geht beim nächsten Projekt verloren. Wir brauchten einen Mechanismus, bei dem jede Ausführung das System automatisch schlauer macht.

Wie das in der Praxis aussieht: Die KI führt unser Kundenprojekt-Onboarding durch. Der Kunde hat eine besondere Anforderung: Ein NDA muss vor dem Projekt-Hub-Sharing unterzeichnet werden. Das war im Standardprozess nicht vorgesehen. Die KI erledigt das Onboarding, loggt aber automatisch: „Compliance-Anforderung NDA war nicht im Skill dokumentiert. Vorschlag: Prüfschritt für besondere Compliance-Anforderungen ergänzen."

Das Learning landet in der Feedback-Datenbank. Beim nächsten Review wird die Arbeitsanweisung gepatcht. Und beim nächsten Onboarding weiß die KI das automatisch. Kein Mensch muss daran denken.

Je mehr Aufgaben die KI ausführt, desto mehr Learnings sammelt sie, desto besser werden die Anweisungen, desto besser werden die Ergebnisse.

Okay, aber wie?

Wie kannst du das jetzt in deinem Tool-Stack umsetzen?

Ich habe im letzten Newsletter beschrieben, dass wir uns gerade in einem fundamentalen Shift befinden: weg von Chatbots, hin zu General Purpose Agents. Agenten, die eigenständig auf Daten, Tools und Skills zugreifen können. Claude ist da aktuell am weitesten. Aber ich habe in den letzten Wochen mit mehreren KI-Anbietern über ihre Roadmaps gesprochen – und was ich da sehe, bestätigt: Diese Architektur wird auf Feature-Ebene von immer mehr Anbietern eingeführt.

OpenAI hat in dieser Woche Skills in ihre Business-Produkte eingeführt, Copilot hat ebenfalls schon eine Ankündigung gemacht und auch Anbieter wie Langdock werden auf diese Logik wechseln.

Die Frage ist also nicht, ob deine KI-Plattform irgendwann in der Lage sein wird, als Betriebssystem zu funktionieren. Die Frage ist, ob du bereit bist, wenn es das kann.

Bereit sein bedeutet:

- Deine Abläufe aka Skills konsequent dokumentieren

- Deinen Kontext sauber zusammenziehen – an einem Ort, strukturiert, maschinenlesbar.

- Die Schnittstellen zu deinen Tools für KI zugänglich machen, damit KI sie bedienen kann

- Die Logiken definieren, die dein System braucht: Wer darf was? Wann greift ein Mensch ein? Wie fließen Learnings zurück?

Du musst nicht alles auf einmal umsetzen. Aber du solltest heute anfangen, die Voraussetzungen zu schaffen – denn wenn die Plattformen so weit sind, zählt nur noch, wer seine Hausaufgaben gemacht hat.

🏁 Fazit

Vor 9 Wochen haben wir angefangen, unser Unternehmen als Betriebssystem neu zu denken. Die Bausteine sind aus der täglichen Arbeit gewachsen – aus Fehlern und aus der Erkenntnis, dass einzelne Agenten nicht skalieren.

Ein Skill allein ist eine gute Arbeitsanweisung. Aber ein Skill, der seinen Kontext kennt, sich an Governance hält, von einem generischen Executor ausgeführt wird und über die Feedback-Datenbank lernt – das erzeugt am Ende den Hebel.

Und es gibt noch einen Layer, auf den ich heute bewusst nicht im Detail eingegangen bin: den Agentic Layer. Auf dem KI-Betriebssystem arbeitet bei uns mittlerweile eine Kette an Agenten, die einlaufende Arbeit automatisch erledigen – indem sie sich dynamisch aus genau diesen Bausteinen bedienen. Sie finden den richtigen Skill, laden den passenden Kontext, halten sich an die Governance und loggen ihr Feedback.

Dazu werde ich in den nächsten Wochen noch schreiben.

Zuerst will ich tiefer in den wichtigsten Baustein einsteigen: Skills. Was genau ein Skill ist, wie man ihn baut, wie man ihn einsetzt. Skill-Engineering wird eines der größeren Themen für den Rest des Jahres sein.

Bis nächsten Sonntag,

Felix

P.S. Ab April nehmen wir wieder neue Mitglieder ins Collective auf. Wenn du sehen willst, wie wir dieses Betriebssystem konkret aufgebaut haben, und mit anderen Führungskräften daran arbeiten willst, dasselbe für dein Unternehmen zu tun — dann ist das der richtige Ort dafür.

Registriere dich kostenlos,

um den vollständigen Artikel zu lesen.

vollständige Insights

Hub-Werkzeugen

und diskutiere mit

an einem Ort