Governance im KI-Betriebssystem

Wie wir definieren, was KI darf - und was nicht

Herzlich Willkommen zu den AI FIRST Insights! Dies ist der nächste Teil der Serie über die Bausteine unseres KI-Betriebssystems und wie wir diese Bausteine designed haben.

Die bisherigen Artikel findest Du hier:

- Agenten: Die Ausführungseinheit auf dem Betriebssystem

- Skills (Prozesse): Alles, was unsere Organisation kann

- Kontext (Daten): Alles, was unsere Organisation weiß

Heute kommt der nächste Baustein: die Governance. Also alle Regeln, die für KI innerhalb des Betriebssystems gelten, damit Risiken minimiert werden und KI in unserem Interesse handelt.

Los geht's!

Warum Governance?

Wenn ich in den letzten Wochen über die Idee gesprochen habe, KI als Betriebssystem aufzusetzen, kam nach Vorträgen oder auf LinkedIn eine Reaktion immer wieder: „Klingt spannend, aber ist das nicht wahnsinnig unsicher? Die KI hat dann ja Zugriff auf alles."

Die Sorge ist nachvollziehbar, aber unvollständig. Wenn wir wollen, dass KI echte Arbeit für uns erledigt, dann braucht sie Zugriff auf die Daten, die Prozesse und die Systeme, mit denen wir Menschen arbeiten. Ohne diesen Zugriff bleibt KI das, was die meisten schon kennen: Ein Chatbot, mit dem man ein paar Ideen hin- und herspielt, vielleicht ein paar Dokumente befragt, der aber am Ende nichts wirklich für einen erledigt.

Wer zum Beispiel sagt „Die KI soll keinen Zugriff auf unser CRM bekommen", muss wissen, dass damit sämtliche Aufgaben wegfallen, die mit Kundendaten zu tun haben - Angebote vorbereiten, Kontakte pflegen, Follow-ups schreiben. Beides gleichzeitig geht nicht: KI soll echte Arbeit übernehmen, aber keinen Zugang zu den Systemen bekommen, in denen diese Arbeit stattfindet.

Die eigentliche Frage ist also nicht, ob KI Zugriff bekommt, sondern welche Regeln dabei gelten müssen. Und diese Regeln dürfen wir definieren. Dafür braucht ein KI-Betriebssystem eine Governance-Schicht mit klaren Regeln, die definieren, was KI autonom darf, was sie nur mit menschlicher Freigabe tut und welche Arbeit komplett beim Menschen bleibt.

Dabei steht über allem: Rechtskonformität bzgl. DSGVO und anderen Gesetzen muss immer sichergestellt sein, und die eingesetzten KI-Modelle dürfen nicht auf Unternehmensdaten trainiert werden. Dies kann insbesondere über die Auswahl der passenden technischen Plattform gewährleistet werden.

Beides sind selbstverständliche Grundvoraussetzungen, die ich in diesem Artikel nicht noch einmal explizit thematisieren werde.

Von der Richtlinie für Mitarbeiter zur Richtlinie für KI

Ich habe in den letzten zwei Jahren sehr viele KI-Richtlinien für Mitarbeiter gesehen. Teilweise 20 Seiten lang, in denen im Detail steht, welche Tools erlaubt sind, welche nicht, welche Daten in welches Tool dürfen, was passiert wenn jemand dagegen verstößt und an wen man sich bei Problemen wendet. Diese Richtlinien richten sich in erster Linie an Menschen, die mit KI arbeiten wollen oder sollen.

Wenn KI aber nicht mehr nur ein Werkzeug ist, sondern als Betriebssystem einen wachsenden Teil der Arbeit eigenständig ausführt, brauchen wir eine zweite Richtlinie: eine für die KI selbst. Eine, die ihr Verhalten innerhalb des Systems steuert - was sie autonom erledigen darf, wo sie pausieren und auf menschliche Freigabe warten muss und was sie gar nicht erst anfassen soll.

Wir haben dafür ein Governance-Handbuch geschrieben.

Was steht drin?

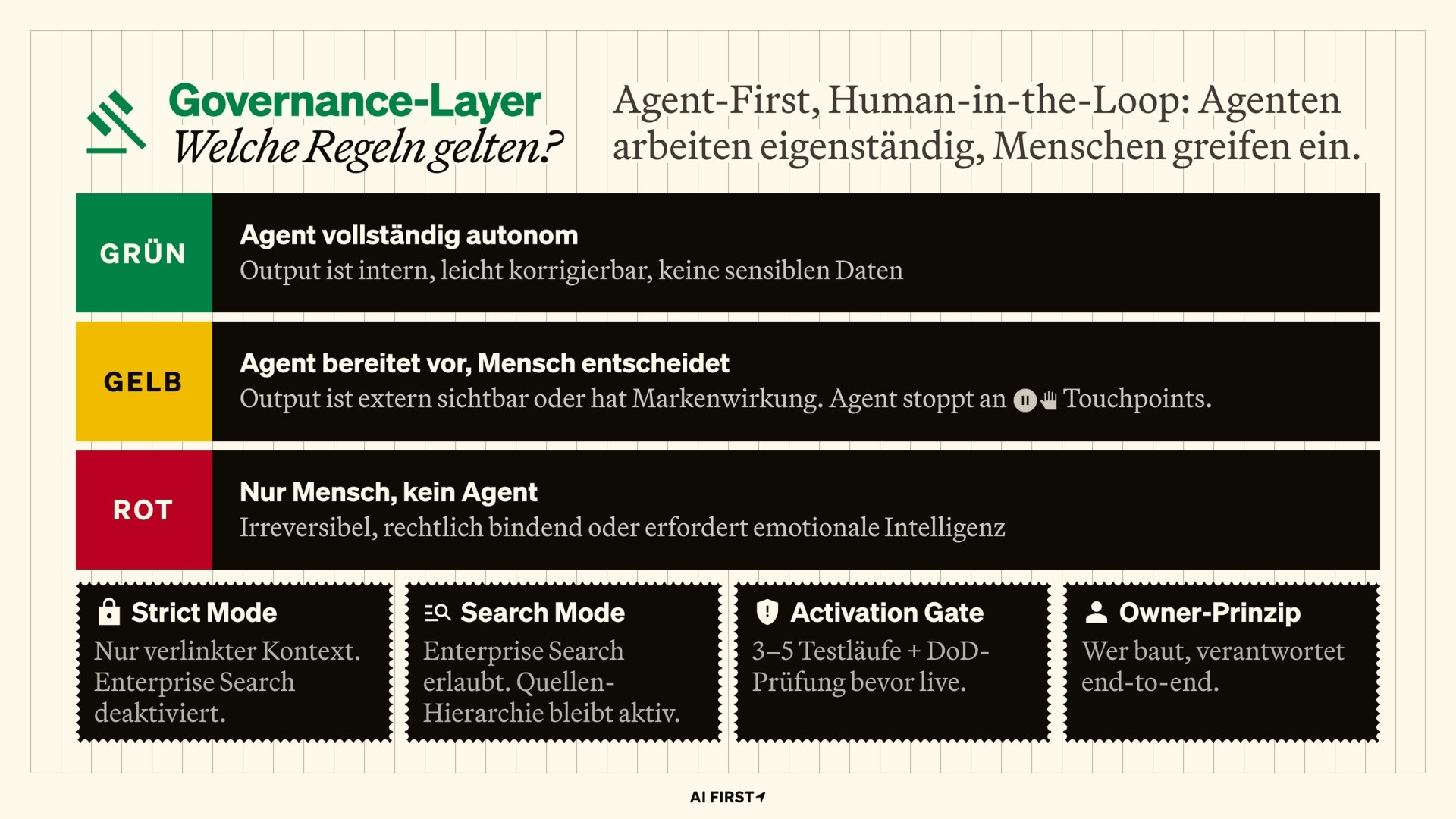

Das Kernstück ist ein Ampel-System, das für jeden Skill definiert, wie viel Autonomie die KI dabei hat:

- 🟢 Grün bedeutet vollständig autonome Ausführung. Die KI bekommt einen Auftrag und liefert das Ergebnis, ohne dass ein Mensch eingreifen muss. Bei uns betrifft das zum Beispiel Meeting-Zusammenfassungen, Daten-Formatierung oder interne Statusreports. Aufgaben mit klarem Input und Output, bei denen ein Fehler leicht zu korrigieren wäre.

- 🟡 Gelb bedeutet, die KI bereitet vor und ein Mensch reviewed. Sie erstellt einen vollständigen Entwurf, pausiert dann an definierten Stellen und wartet auf Freigabe. Kundenangebote, Marketing-Texte oder Projektdokumentation fallen bei uns in diese Kategorie. Alles, was nach außen geht oder eine gewisse Qualitätsanforderung hat.

- 🔴 Rot bedeutet, die KI unterstützt nur mit Recherche oder Vorarbeit, aber die eigentliche Aufgabe macht der Mensch. Vertragsverhandlungen, Budget- oder Personalentscheidungen - also Aufgaben, bei denen ein fehlerhafter Output nicht einfach korrigierbar wäre.

Neben dem Ampel-System definiert das Handbuch auch, wie menschliche Kontrollen konkret aussehen. Bei jedem gelben oder roten Skill ist in der Arbeitsanweisung markiert, an welcher Stelle genau die KI pausiert und ob sie dort eine Freigabe braucht, eine zusätzliche Information vom Menschen benötigt oder einen fertigen Entwurf zur Prüfung vorlegt.

Die Kontroll-Schranken sind nicht nur im Governance-Handbuch hinterlegt, sondern auch direkt in die Prozesse integriert. Wenn beispielsweise ein Angebot erstellt wurde, wird in der Datenbank der Status vom Agent auf “Review” geändert, was wiederum eine Benachrichtigung an den verantwortlichen Kollegen auslöst.

Wie wird es genutzt?

Das Governance-Handbuch ist in unserem System als Kern-Kontext für den Agenten hinterlegt und wird bei jeder einzelnen Skill-Ausführung automatisch geladen. Der Agent liest vor jeder Aufgabe zuerst die Governance-Regeln, bevor er mit der eigentlichen Arbeit beginnt.

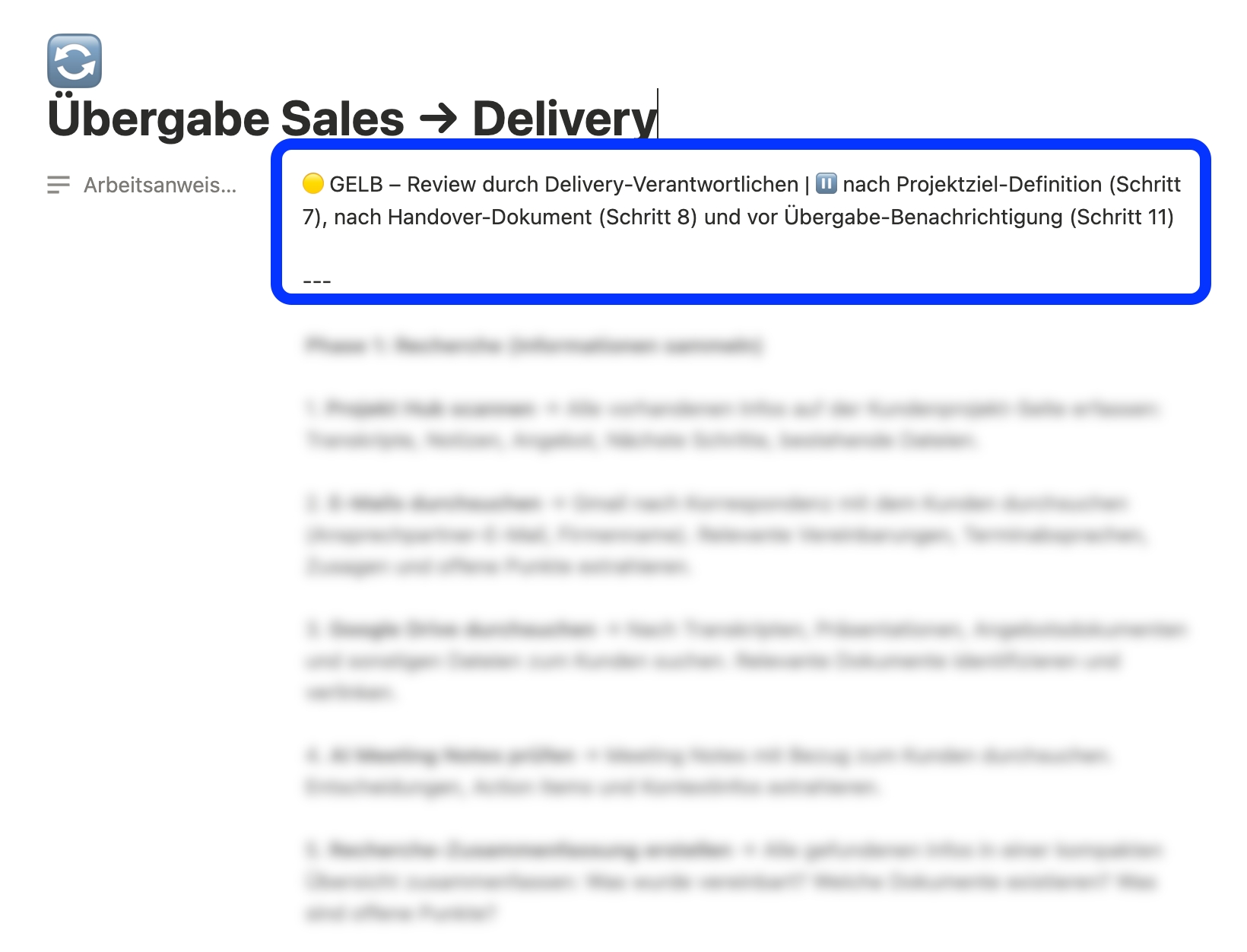

Außerdem beginnt jede Arbeitsanweisung eines Skills mit der Governance-Ampel. Der Agent weiß dadurch, ob er durcharbeiten darf, wo er pausieren muss oder ob er nur zuarbeiten soll.

(Beispiel einer Skill-Dokumentation)

Die Governance-Regeln fließen auch in die Erstellung neuer Skills ein. Wer einen neuen Skill baut, muss als erstes die Ampel-Farbe definieren und die Kontrollpunkte setzen. Kein Skill geht ohne diese Zuordnung in den produktiven Einsatz.

Wie Governance im System wirkt

Das Governance-Handbuch steuert das Verhalten der KI innerhalb des Systems und gibt die Autonomie für jeden ausführbaren Skill vor. Das Handbuch allein reicht natürlich nicht aus, denn wenn ein Agent zu halluzinieren beginnt und sich entscheidet die Regeln zu ignorieren, entstehen ungewollte Risiken.

Deshalb gibt es architektonische Sicherheitsmechanismen, die allein durch das Systemdesign greifen.

Die wichtigsten Mechanismen liste ich Dir hier auf:

Keine autonomen externen Aktionen.

Unser System kann ohne menschliche Freigabe keine E-Mails versenden, Verträge verschicken oder Daten an Dritte übermitteln. Die KI hat die entsprechende Aktion schlicht nicht zur Verfügung, solange kein Mensch sie freigibt. Das adressiert auch direkt das Thema Prompt Injection: Selbst wenn jemand versuchen würde, über manipulierte Eingaben - ein präpariertes Dokument, eine E-Mail mit versteckten Anweisungen - einen Informationsabfluss zu erzwingen, kann die KI ohne menschliche Freigabe keine Informationen nach außen senden.

Zugriffsrechte werden durchgezogen.

Ein Einwand, der immer wieder kommt: „Wenn KI auf alles zugreifen kann, haben dann plötzlich alle Mitarbeitenden Zugriff auf alles?" Die Zugriffsrechte, die mit den einzelnen Nutzerkonten verbunden sind, gelten auch für die KI. Wer keinen Zugriff auf die Personaldaten hat, hat auch über die KI keinen Zugriff darauf.

Kontext-Isolation.

Darüber hinaus sieht die KI bei einer Aufgabe nur den Kontext, der dem jeweiligen Skill explizit zugewiesen wurde. Wenn der Onboarding-Skill keinen Zugriff auf die Finanzdaten braucht, bekommt er ihn auch nicht - selbst wenn der ausführende Nutzer diese Rechte hätte. Das reduziert das Risiko von Informationslecks und verbessert gleichzeitig die Ergebnisse, weil die KI sich auf die relevanten Daten konzentriert.

Quellen-Hierarchie bei Widersprüchen.

Wenn verschiedene Informationsquellen sich widersprechen, gibt es eine klare Rangfolge: Die Arbeitsanweisung des Skills hat immer die höchste Priorität, danach kommt der verlinkte Kontext, und erst an letzter Stelle stehen Informationen aus einer breiteren Suche im System.

Keine Selbstmodifikation.

Die KI kann ihre eigenen Anweisungen und Governance-Regeln nicht ohne vorherige Freigabe verändern. Wenn sie während einer Ausführung feststellt, dass ein Skill verbessert werden könnte, schlägt sie eine Änderung vor. Umgesetzt wird sie erst, wenn der verantwortliche Mensch bestätigt.

Owner-Prinzip.

Jeder Skill hat einen verantwortlichen menschlichen Owner. Wenn etwas schiefgeht, ist immer klar, wer zuständig ist und wer die Regeln anpassen kann. Der Owner kommt immer aus dem jeweiligen Fachbereich.

Activation Gate.

Kein Skill geht ungetestet in den produktiven Einsatz. Bevor ein Skill auf „Aktiv" gesetzt wird und vom Agenten genutzt werden kann, durchläuft er einen definierten Qualitätscheck: Mindestens fünf Testläufe mit realistischen Eingaben, die Ergebnisse werden gegen die Definition of Done geprüft, Abweichungen dokumentiert und eingearbeitet. Erst wenn der Skill dieses Gate bestanden hat, darf er produktiv arbeiten.

Zusammengenommen bilden diese Mechanismen ein Sicherheitsnetz, das auf mehreren Ebenen greift. Das Governance-Handbuch steuert das Verhalten der KI im System, die architektonischen Guardrails begrenzen, was überhaupt möglich ist, und das Activation Gate stellt sicher, dass nichts Ungetestetes im Produktivbetrieb landet.

🏁 Fazit

Je mehr wir uns damit beschäftigt haben, KI als Betriebssystem in unserem Unternehmen zu leben, desto klarer wurde und, dass Governance kein Nice-to-have ist. Ohne klare Regeln lassen sich die Vorteile eines KI-Betriebssystems nicht nutzen, weil das Vertrauen in das System und die Ergebnisse fehlt.

Wichtig: Die oben beschriebenen Regeln und Umsetzungsansätze sind unsere individuelle Entscheidung basierend auf unserer Risikobewertung. Ich empfehle eine eigene Bewertung der Risiken und Ableitung der Maßnahmen für euren spezifischen Unternehmenskontext.

Was du aus diesem Artikel mitnehmen kannst:

- Wenn KI echte Arbeit übernehmen soll, braucht sie Zugriff auf Daten, Prozesse und Systeme. Die Frage ist nicht ob man das tut, sondern welche Regeln dabei gelten.

- Ein Governance-Handbuch mit klarer Ampel-Logik definiert für jeden Skill, wie viel Autonomie die KI hat und wo ein Mensch eingreift.

- Dieses Handbuch ist Kern-Kontext des Agenten und wird bei jeder Ausführung geladen. Außerdem ist es direkt in die Erstellung neuer Skills integriert.

- Architektonische Guardrails - von Zugriffsrechten über Kontext-Isolation bis zum Activation Gate - bilden das Sicherheitsnetz, das über die bewussten Regeln hinaus greift.

Nächste Woche schauen wir uns noch den letzten Baustein an: die Lernschleife, die das System mit jeder Ausführung ein bisschen besser werden lässt.

Bis dahin wünsche Dir frohe Ostern und eine erholsame Zeit!

Bis nächsten Sonntag,

Felix

Registriere dich kostenlos,

um den vollständigen Artikel zu lesen.

vollständige Insights

Hub-Werkzeugen

und diskutiere mit

an einem Ort