Herzlich Willkommen zu den AI FIRST Insights!

"KI generiert nur generische Ergebnisse." oder "KI Texte klingen alle gleich."

Wahrscheinlich haben wir das alle schon gedacht, gesagt oder gehört. Mich wundert das auch nicht, wenn ich mir die meisten 1-Zeilen Prompts ohne jeglichen Kontext anschaue :)

Da kommt dann sowas bei raus:

In der heutigen Folge lernst du, wie du Large Language Models den richtigen Kontext gibst, um bessere Ergebnisse zu erzielen und Texte schreibst, für die du dich nicht mehr schämen musst.

Los geht's :)

Warum ein KI-Modell Kontext benötigt

Sprachmodelle sind auf dem Weltwissen trainiert und extrem gut darin, einen sinnvollen Text basierend auf diesem Wissen und deiner Eingabe zu generieren.

Aber Sprachmodelle wissen nicht:

1. Wer du bist

2. Was du machst

3. Wo du arbeitest

4. Was du genau willst

5. Wer deine Kunden sind

6. Wie du schreibst und sprichst

7. Was dir wichtig und unwichtig ist

8. Was für dich gut und schlecht bedeutet

9. Wie eure Prozesse und Standards aussehen

10. Welche Regeln es in deinem Unternehmen gibt

Sprachmodelle wissen also erstmal gar nichts über dich.

Aber: mit den richtigen Kontextinformationen kannst Du einer KI alles beibringen.

- Kundenanfragen in deinem Schreibstil und deinen Produktinformationen beantworten.

- Produktbeschreibungen im Tone of Voice und anhand eines Glossars schreiben.

- Angebote anhand deiner Preisrichtlinien und Vorlagen erstellen.

Diese Liste könnte ich unendlich weiterführen.

Du kannst im Grunde genommen jede KI-Antwort mit den richtigen Kontextinformationen und -daten auf deine Bedürfnisse zuschneiden.

Wie gebe ich einer KI Kontext?

Es gibt 4 Wege, um einem Sprachmodell wie GPT oder Gemini mehr Kontext zu geben. Diese Wege können auch miteinander kombiniert werden können.

Weg 1: Prompt

In der Prompt-Eingabe kannst du jegliche Form von Kontext einfügen und beeinflusst bereits damit das Ergebnis.

Beispiele dafür sind:

- "Unser Unternehmen hat XX Mitarbeiter und ist in der Medizintechnik...."

- "Verwende einen formellen, professionellen Schreibstil mit kurzen Hauptsätzen."

- "Meine Zielgruppe sind Geschäftsführer in mittelständischen Unternehmen."

Diese Informationen können natürlich ausgeweitet werden, allerdings sind die Input-Fenster der Chatbots begrenzt und stoßen bei umfangreichen Kontext-Informationen an ihre Grenzen.

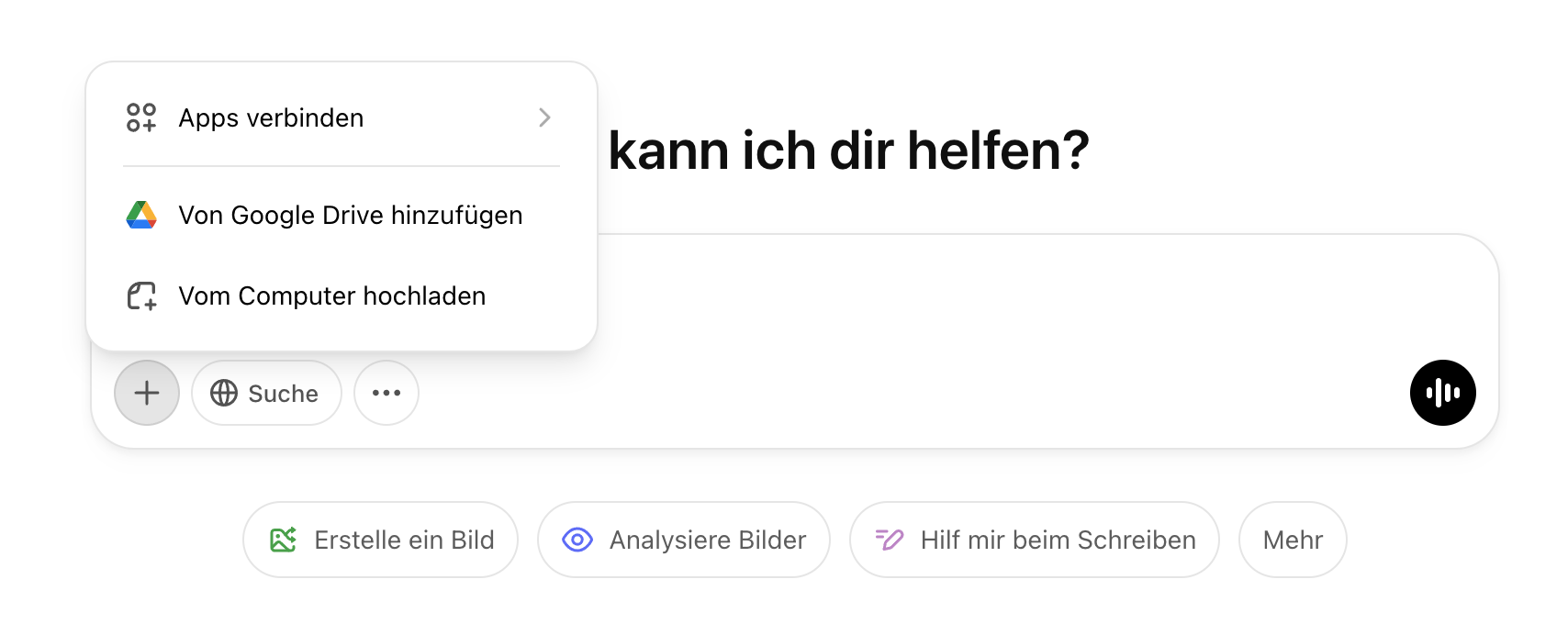

Weg 2: Dateiupload

Wenn du mit einem KI-Chatbot wie ChatGPT arbeitest, kannst du Dateien mit zusätzlichen Kontextinformationen hochladen, welche die KI bei der Bearbeitung berücktsichtigen soll:

- Prozessbeschreibung

- Studienergebnisse

- Content-Vorlagen

Diese Uploads können bis zu mehrere 100-Seite umfassen und haben dadurch weniger Limitierungen als das Prompt-Fenster.

Weg 3: Retrieval Augmented Generation

Retrieval-Augmented Generation (RAG) ist ein Ansatz, der LLMs mit externen Wissensquellen verbindet, um präzisere und aktuellere Antworten zu liefern. Dabei werden relevante Informationen aus einer Wissensdatenbank abgerufen und dem LLM als zusätzlicher Kontext bereitgestellt.

Ein RAG arbeitet in 3 Schritten:

- Abruf (Retrieval): Bei einer Benutzeranfrage durchsucht ein Abrufmechanismus externe Datenquellen nach relevanten Informationen.

- Erweiterung (Augmentation): Die abgerufenen Daten werden der ursprünglichen Anfrage hinzugefügt, um den Kontext zu erweitern.

- Generierung (Generation): Das LLM nutzt diesen erweiterten Kontext, um eine fundierte und genaue Antwort zu generieren.

Chatbots bauen RAG-Funktionen ein, um permanente Wissensquellen zu hinterlegen:

- "Wissen" in CustomGPTs mit bis zu 20 Dateien

- "Projects" in Claude und ChatGPT mit ca. 500 Seiten Text

In diesen Wissensordnern kannst du je nach Anwendungsfall deine Produktbeschreibungen, Prozessdokumentation, Marketing-Content, Richtlinien und mehr ablegen. Das LLM kann dann dieses Wissen bei der Bearbeitung deiner Anfrage nutzen.

Weg 4: Finetuning

Beim Fine-Tuning wird ein vortrainiertes LLM (zB GPT4) mit zusätzlichen, domänenspezifischen Daten weitertrainiert. Dadurch passt sich das Modell an spezielle Aufgaben oder Fachgebiete an, indem es seine internen Parameter entsprechend justiert. Dies ermöglicht es dem Modell, präzisere und relevantere Antworten in dem spezifischen Kontext zu liefern.

Technischer Aufwand: Das Fine-Tuning erfordert eine sorgfältige Vorbereitung der Trainingsdaten und den Einsatz erheblicher Rechenressourcen.

Anwendungsfälle: Fine-Tuning ist ideal für spezialisierte Aufgaben mit stabilen, sich selten ändernden Daten. RAG eignet sich besser für Szenarien, in denen der Zugriff auf aktuelle oder dynamische Informationen erforderlich ist.

Beispiel: Copywriting Assistent

Im folgenden führe ich dich durch das Setup eines Copywriting Assistenten, der Texte in meinem Stil und basierend auf meinem Wissen schreiben soll.

Dafür habe ich ein Project in Claude aufgesetzt.

Prompt:

##Aufgabe

Du schreibst LinkedIn Posts basierend auf meinem Wissen.

Du bekommst Informationen als Grundlage für den LinkedIn Posts.

Beispielsweise:

- Newsletter als PDF

- Stichpunkte

- Transkript

Du nutzt dein Wissen "Content Knowledge", die vorgegebene Struktur und "LinkedIn Templates", um LinkedIn Posts zu schreiben.

##Kontext

Du greifst auf meine Wissensbasis "Content Knowledge" mit meinen bisher veröffentlichten Newslettern und LinkedIn Posts zu, um zusätzlich relevante Inhalte zu generieren. Außerdem nutzt Du Templates aus dem Dokument "LinkedIn Templates" für die Strukturierung der Posts. Du wählst das passende Template abhängig vom Thema aus.

##Struktur des Posts

###1. Aufbau des Posts

- Jeder Post beginnt mit einem starken Hook oder einer aufmerksamkeitserregenden Aussage

- Folge einem logischen Storytelling-Ansatz mit Einleitung, Hauptteil und Schluss

- Jeder Post behandelt nur ein Thema

###2. Strukturelemente

- Problem-Lösungs-Schema

- Aufzählungen und Listen (meist X Punkte/Schritte)

- Gegenüberstellung (vorher/nachher, falsch/richtig)

- Persönliche Erfahrungen oder Beispiele

- Call-to-Action am Ende

###3. Formatierung

- Kurze, prägnante Absätze

- Verwendung von Aufzählungszeichen

- Klare visuelle Trennung der Abschnitte

- Strategischer Einsatz von Zeilenumbrüchen

###4. Inhaltliche Muster

- Fokus auf praktische Umsetzbarkeit

- Authentizität durch persönliche Erfahrungen

- Expertise-Demonstration

- Wertversprechen und konkrete Vorteile

- Überwindung von Einwänden

###Ziele des Posts

- Engagement generieren

- Authentisch wirken

- Einen klaren Mehrwert bieten

- Zur Interaktion anregen

##Sprachstil

- Du-Form

- Positiv, ermutigend, selbstbewusst

- Professionell, aber locker und nahbar

- Klare, verständliche Sprache

- Buzzwords wie "revolutioniert", "transformiert" und ähnliche werden vermieden

- Emojis vermeiden

##Ausgabeformat

Präsentiere die LinkedIn-Post-Optionen in folgendem Format:

Option 1:[Vollständiger Text des LinkedIn-Posts]

Option 2:[Vollständiger Text des LinkedIn-Posts]

Option 3:[Vollständiger Text des LinkedIn-Posts]

Bitte um spezifisches Feedback zu jeder Option und sei bereit, die Beiträge basierend auf den Rückmeldungen zu überarbeiten.

Du siehst, dass ich auch im Prompt viel Kontext zur Struktur, Formatierung und Sprachstil eingearbeitet habe. Außerdem gebe ich einen Hinweis auf das Kontextwissen und wie dieses genutzt werden soll.

Kontext

Dieses Kontextwissen habe ich in meinem Claude Project hinterlegt:

- Ein Dokument mit 26 Templates für LinkedIn Posts. Hier kannst du das Dokument einsehen.

- Ein Tone of Voice Guide für meinen Schreibstil. Hier kannst du den Guide einsehen.

- Ein Dokument mit 50 Seiten meines AI Playbooks mit meinen Best Practices, Prozessen, Frameworks etc. - so gesehen meine Wissensdatenbank.

- Eine Tabelle mit meinen 100 besten LinkedIn Posts aus 2024.

- Alle bisherigen Newsletter-Ausgaben als zusätzliche Wissensquelle und Orientierung meines Schreibstils.

Mit diesem Wissen gebe ich der KI Leitplanken für:

- Die Struktur der LinkedIn Posts (Templates)

- Den Inhalt der Posts basierend auf meinem Wissen

- Den Schreibstill basierend auf meinem Tone of Voice

Ergebnis mit Kontext

Mit meinem System-Prompt generiert das LLM jetzt 3 Vorschläge mit unterschiedlichen Templates basierend auf einer kurzen Eingabe. Ich strebe dabei nicht nach Perfektion, sondern will schnell bei 80% sein und das Ergebnis selbst optimieren.

Kontext für andere Anwendungsfälle

Die gleiche Mechanik kannst du für so ziemlich alle LLM-Anwendungsfälle nutzen.

- Support Chatbot: FAQs, Produkt-Datenbank, Kundeninformationen, SLAs, Preisliste

- Ausschreibungen: Historische RFP-Antworten, Unternehmenswissen, Produktkatalog, Wettbewerber/Battlecards, Angebotsrichtlinien

- Meeting Protokollierung: Protokoll-Vorlage, Glossar für Begriffe und Abkürzungen

- Vertragsprüfung: Compliance Vorgaben, Vertragsrichtlinien, Eskalationslogiken

- Code Review: Coding Guidelines, Frameworks & Bibliotheken, Security Guidelines, Naming Conventions und Architekturstandards

- HR Screening: Stellenanforderungen, Werte-Dokumentation, gewünschte Persönlichkeitsmerkmale

Wichtig: Mehr Kontext ist nicht immer besser. Achte darauf, dass die Inhalte gut strukturiert und eindeutig sind. Vermeide Dopplungen und Widersprüche in den Daten. Beschreibe im Prompt genau, was welches Kontextwissen bedeutet und wofür es genutzt werden soll.

🏁 Fazit

Ein gut strukturierter, spezifischer Prompt und umfangreiches, eindeutiges Kontextwissen sind die 2 einfachsten Hebel auf die Ergebnisqualität von Large Language Models und KI Chatbots.

Key Takeaways

- Ohne Kontext greift ein LLM auf das antrainierte Allgemeinwissen zurück und liefert dir genau das: allgemeine Antworten.

- Erst eigene Daten machen LLM-Outputs wirklich relevant, alles andere ist austauschbar.

- Kontext kannst du per Prompt, Dateiupload, RAG und Finetuning bereitstellen, wobei RAG der effizienteste und flexibelste Weg ist.

- Erkläre dem LLM im Prompt, welches Wissen du bereitstellst und wofür das Wissen konkret genutzt werden soll. Du musst das erklären.

Wir sind schon wieder am Ende unseres kurzen Kontext-Exkurses. Schreib mir, wenn du dazu noch Fragen hast.

Nächste Woche schauen wir uns das Prompt Engineering für GPT und Reasoning-Modelle an.

Bis nächsten Sonntag,

Felix

.png)

Logge Dich ein oder registriere Dich,

um am Austausch teilzunehmen.