#47Wie funktioniert Hyperpersonalisierung?

Intro

In dieser Episode des AI FIRST Podcast spricht Felix mit Florian Johannsen, Head of Data Science bei Freenet, über echte Hyperpersonalisierung im Telekommunikationsmarkt. Ein faszinierender Einblick, wie ein Unternehmen mit 16 Millionen Kunden den Spagat zwischen 25 verschiedenen Tarifen und individueller Kundenansprache meistert – und dabei zeigt, was Hyperpersonalisierung jenseits von Content-Generierung wirklich bedeutet. Die zentrale Erkenntnis: Ohne funktionierendes A/B-Testing-Framework und strukturgleiche Kundengruppen ist Hyperpersonalisierung wie "mit der Schrotflinte in den Wald schießen". Florian erklärt, warum die Dateninfrastruktur wichtiger ist als das neueste LLM und wie Freenet aus 25 Tarifen eine Chance statt ein Problem gemacht hat.

Inhaltsuebersicht

- Definition von Hyperpersonalisierung – Der Unterschied zwischen Standard-Personalisierung und N=1-Ansätzen ohne Begrenzung der Varianten

- Das Geschäftsproblem hinter der Innovation – Wie 25 Tarife zur Chance für bessere Kundenansprache werden

- A/B-Testing als Fundament – Warum strukturgleiche Kundengruppen und Feedback-Loops die absolute Grundlage sind

- Praktische Umsetzung der Hyperpersonalisierung – Von anonymen Besuchern bis zu personalisierten Vertragsverlängerungen

- LLM-Einsatz und Herausforderungen – Metaprompting, Datenschutz und Human-in-the-Loop im Kundenservice

- Foundation Models für Forecasting – Wie tabulare Daten und Geschäftszahlenvorhersage revolutioniert werden

- Qualitätssicherung durch KI – Vollumfängliche Überprüfung der Telefonie-Vermarktung statt Stichproben

- Unstrukturierte Daten nutzbar machen – Freitexte klassifizieren und in klassische ML-Modelle integrieren

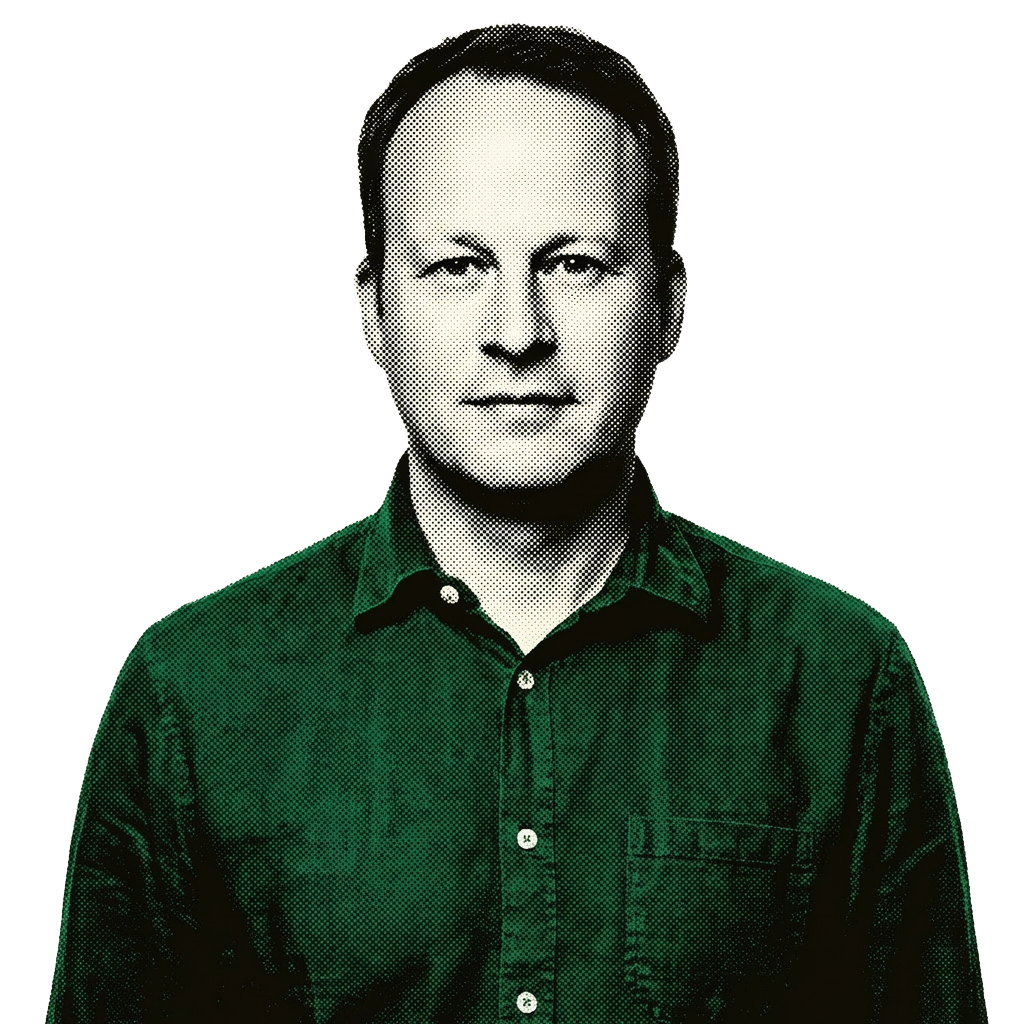

Ueber den Gast

Florian Johannsen ist Head of Data Science bei Freenet und verantwortet die Abteilung Data Science im Bereich Data and Intelligence. Seit über zehn Jahren bei Freenet hat er das Data Science Team von zwei auf 16 Personen aufgebaut. Die Teams sind nicht nach Methodik organisiert – es gibt kein separates LLM-Team –, sondern nach Geschäftsbereichen wie Empfehlungsdienste, Hyperpersonalisierung, Forecasting und Online-Optimierung. Die Mission: Entwicklung datengetriebener Geschäftsprozesse, die durch Algorithmen messbar verbessert werden. Florians Ansatz folgt der Maxime, dass jedes Team den vollen Methodenbaukasten beherrschen soll, um für jeden Use Case das beste Werkzeug zu wählen – nicht nur den Hammer, den man gerade in der Hand hält.

Detaillierte Zusammenfassung

Was ist Hyperpersonalisierung wirklich?

Hyperpersonalisierung ist für Florian der konsequente Gegenentwurf zu One-Size-Fits-All-Lösungen oder der Arbeit mit vordefinierten Personas. "Hyperpersonalisierung bedeutet für mich, dass es keine Begrenzung gibt, wie viele Varianten es geben kann." Statt fünf feste Kundengruppen zu definieren, geht es darum, eine unbegrenzte Varianz an Kontaktpunkten mit individuellen Kundenbedürfnissen zu matchen. Dies funktioniert sowohl bei anonymen Besuchern – die bereits durch Uhrzeit, Wochentag und technische Parameter differenziert werden können – als auch bei Bestandskunden, wo deutlich mehr Daten verfügbar sind.

Der entscheidende Unterschied zur klassischen Personalisierung: Die Anzahl möglicher Varianten ist nicht von vornherein limitiert, sondern ergibt sich dynamisch aus Kundenverhalten und A/B-Tests. "Das Tolle an generativer KI ist, dass das Erstellen von Varianten deutlich einfacher geworden ist." Während ein Mensch nach zwei, drei kreativen Betreffzeilen-Varianten an seine Grenzen stößt, kann generative KI nahezu unbegrenzt sinnvolle Varianten erstellen – vorausgesetzt, die dahinterliegende Infrastruktur stimmt.

Vom Geschäftsproblem zur Innovation

Freenet steht vor einer besonderen Herausforderung: Das Unternehmen bietet deutlich mehr Tarifvarianten als seine Mitbewerber – konkret 25 verschiedene Tarife. Diese Komplexität könnte man als Problem betrachten und Produktvarianten streichen. Freenet hat sich jedoch bewusst für den umgekehrten Weg entschieden: Die Vielfalt wird als Chance für individuellere Angebote genutzt.

Die zentrale Frage wurde: Wie finden wir die richtigen Angebote für die richtigen Kunden und wie kommunizieren wir sie verständlich? Aus Kundensicht ist die Herausforderung offensichtlich: Wer auf eine Website mit 25 verschiedenen Bundles, Geschwindigkeiten und Konditionen kommt, ist schnell überfordert. Genau hier setzt Hyperpersonalisierung an: Das richtige Angebot für den richtigen Kunden finden, den Tarif anders erklären je nach Kundenkenntnis – einfache Sprache für manche, Fachbegriffe für andere – und unterschiedliche Tarifmerkmale in den Vordergrund stellen, je nachdem, was für den individuellen Kunden relevant ist.

A/B-Testing als unverzichtbares Fundament

Der Kern von Freenets Ansatz liegt in der Stratifizierung von Kundengruppen. Statt zufällige Auswahl werden strukturgleiche Kundengruppen gebildet. Wichtige Merkmale werden identifiziert und strukturgleich hergestellt, um A/B-Tests auf nahezu identische Kundengruppen auszurichten. Florian betont: Ohne funktionierenden Feedback-Loop ist Hyperpersonalisierung zwecklos. "Ich kann so viel individualisieren, wie ich will. Ich weiß halt nicht, ob es funktioniert."

Ich kann so viel individualisieren, wie ich will. Ich weiß halt nicht, ob es funktioniert.

Die größte Herausforderung beim Aufbau dieses Systems war, einen vollständigen Feedback-Loop zu etablieren: Zu wissen, worauf modelliert wurde, und nachvollziehen zu können, wie Kunden darauf reagiert haben. In Florians Augen ist dies der erste Schritt in die Hyperpersonalisierung und die absolute Grundlage – wichtiger als jedes LLM.

Ein zentrales Problem war historisch die Datensparsamkeit in IT-Systemen. Während Data Scientists das absolute Maximum an Informationen wollen, wurden viele relevante Daten nicht gespeichert. Besonders fehlten Informationen darüber, wie viele Kunden etwas gesehen, aber nicht darauf reagiert haben. Freenet hat in Absprache mit dem Datenschutz zusätzliche Informationen in die Systeme integriert, um weichere Parameter zu erhalten – über das reine "Kunde X hat Y gekauft" hinaus.

Praktische Umsetzung im Kundenalltag

Hyperpersonalisierung greift bei Freenet vor allem bei Bestandskunden, wo mehr Daten verfügbar sind. Konkrete Anwendungen umfassen individualisierte Tarifempfehlungen bei Vertragsverlängerungen, personalisierte Cross-Selling-Angebote für zusätzliche Produkte und experimentelle Individualisierung von Betreffzeilen und Inhalten durch generative KI.

Auch anonyme Kunden bringen viele nutzbare Informationen mit: Uhrzeit und Wochentag des Besuchs, geografische Zuordnung über Geräteheader und technische Mittel. Sofern Einwilligung besteht, können diese Informationen zur Modellierung genutzt werden. Die Frage ist dann: Verhalten sich unterschiedliche Kundengruppen anschließend auch unterschiedlich? Wenn ja, steigen die Chancen, durch individualisierte Journey-Aspekte besseren Service zu liefern oder höherwertige Produkte zu verkaufen.

Eine einfache Regel wäre: Safari-Browser-Nutzer bekommen Apple-Geräte vorgeschlagen. Aber wenn es komplizierter wird, arbeitet Freenet mit Scoring-Verfahren, die deutlich differenzierter funktionieren. Der Fokus liegt derzeit auf Textpersonalisierung, mit Bildwelten wurde experimentiert, aber der Schwerpunkt bleibt zunächst auf Text.

LLM-Einsatz unter strengen Datenschutzauflagen

Freenet steht vor der Herausforderung, sicherzustellen, dass LLMs Kundendaten nur im eigenen Kontext verwenden und nicht zum Nachtrainieren. Dies schränkt die Modellauswahl ein. Hauptanwendungen sind Coding-Unterstützung für Data Scientists, Varianz-Erstellung für A/B-Tests und perspektivisch Kundenservice-Automatisierung.

Florian nutzt persönlich Metaprompting – LLMs zu verwenden, um Prompts zu optimieren, die dann wieder an LLMs gehen. In einem iterativen Prozess wird der Prompt kontinuierlich verbessert, der Input kontrolliert und überprüft, ob die Entwicklung in die richtige Richtung geht. Das einzige Problem: Verschiedene LLMs benötigen sehr unterschiedliche Prompts für gute Ergebnisse.

Für Kundenservice-Automatisierung experimentiert das Team mit Pipecat, einem Framework für Kundenservice-Pipelines. Über APIs können verschiedene Sprachmodelle angebunden werden, um Chatbots, Sprachbots oder E-Mail-Antworten zu generieren. Der Ansatz ist klar Human-in-the-Loop: Ein Mitarbeiter überprüft die Antworten, bewertet sie und schafft ein selbstlernendes System. Florian beobachtet, dass im ersten Schritt oft sogar mehr Aufwände entstehen und Agenten langsamer arbeiten – aber das ist nur ein Zwischenschritt zur annähernd automatisierten Welt.

Die Grundvoraussetzung für erfolgreiche Kundenservice-Automatisierung ist eine gut gepflegte Wissensdatenbank als Single Point of Truth. Für Sprachbots braucht es eine extrem latenzoptimierte Vektordatenbank. Und: Wissen muss nicht nur hinzugefügt, sondern auch wieder entfernt werden können – eine gut historisierte Wissensdatenbank ist essentiell. An diesem Thema arbeitet Freenet noch.

Foundation Models revolutionieren Forecasting

Ein unterschätzter Bereich sind Foundation Models für tabulare Daten und Forecasting. Modelle wie TAB-PFN können Geschäftszahlen für die Zukunft vorhersagen und arbeiten ähnlich wie andere Foundation Models: Sie wurden mit Massivdaten vortrainiert. "Foundation Models für Forecasting haben definitiv das Potenzial, die Art wie Unternehmen Forecasting betreiben, zu revolutionieren."

Foundation Models für Forecasting haben definitiv das Potenzial, die Art wie Unternehmen Forecasting betreiben, zu revolutionieren.

Zwar müssen die eigenen Daten noch zur Verfügung gestellt und Parameter zur Optimierung gesetzt werden, aber vieles – Saisonalität, Trendverläufe – ist allgemeingültig im Unternehmensumfeld. Florian war selbst überrascht von den ersten Ergebnissen und sieht großes Potenzial, besonders wenn nicht so viele Daten vorhanden sind. Diese Modelle übernehmen Aufgaben wie Feature-Extraktion und Modell-Tuning weitgehend automatisch.

Für Freenet ist präzises Forecasting essentiell: Das Unternehmen muss die nächsten ein bis fünf Geschäftsjahre gut vorhersehen können, um weitreichende Vereinbarungen einzuhalten und rechtzeitig zu reagieren. Foundation Models bieten hier eine vielversprechende Entwicklung.

Qualitätssicherung durch bessere Transkription

Ein weiterer konkreter Anwendungsfall ist die Qualitätssicherung in der Telefonie. Freenet will sicherstellen, dass die Vermarktung korrekt abläuft, die Kommunikation korrekt ist, Preise gut verstanden werden und die Kundenzustimmung nachvollziehbar dokumentiert ist. Früher war dies nur stichprobenartig möglich – heute kann es in deutlich größerem Umfang erfolgen.

Generative KI hat hier durch deutlich bessere Transkriptionsalgorithmen einen großen Beitrag geleistet. Früher gab es Cloud-basierte Transkriptions-Services, die nicht besonders gut und recht teuer waren. Heute sind Open-Source-Foundation-Modelle verfügbar, die auf eigenen GPUs betrieben deutlich kostengünstiger sind – und bessere Ergebnisse liefern. Dies ermöglicht umfassendere Qualitätskontrollen zu geringeren Kosten.

Unstrukturierte Daten nutzbar machen

Ein Thema, das Florian immer wieder beschäftigt, ist der Einsatz von KI zur Verarbeitung unstrukturierter Daten. Er erinnert sich an Zeiten, als das Verarbeiten unstrukturierter Daten eine große Herausforderung war – Big-Data-Applikationen rund um Hadoop und Map-Reduce-Jobs. Viele dieser Daten sind seitdem einfach liegengeblieben.

Generative KI kann Freitexte sehr gut verstehen, klassifizieren und Inputs generieren, die dann in klassische Machine-Learning-Modelle eingespeist werden. Plötzlich können Datenquellen genutzt werden, die vorher nicht zugänglich waren – einfach weil es zu aufwändig war, so viele Texte manuell zu lesen, vorzuklassifizieren oder auf Basis weicher Faktoren zu bewerten. Florian sieht dies als eine der total unterschätzten großen Stärken von LLMs.

Vision: Meta übernimmt Marketingproduktion?

Felix wirft eine provokante These von Mark Zuckerberg in die Diskussion: Meta will alle Marketingagenturen ablösen, indem die Plattform selbst die Produktion von Content-Assets übernimmt. Ein Unternehmen promptet nur noch: "Erstelle ein Video für Instagram mit unserem Produkt, das 100.000 Dollar Umsatz bringen soll." Im Hintergrund generiert eine Maschine Skript, Video, Avatar, spielt das Asset an eine kleine Nutzergruppe aus, testet die Performance und optimiert sich dynamisch selbst – Text, Stimme, visueller Inhalt – bis die Conversion Rate hoch genug ist.

Florian sieht den Schlüssel in der Qualitätssicherung durch weitere generative KI, die überprüft, ob das Resultat den Firmenkommunikations-Standards entspricht. Wenn Content massenhaft automatisiert produziert wird, kann ihn kein Mensch mehr in guter Qualität überprüfen. Die Lösung: Modelle kontrollieren sich gegenseitig und stellen sicher, dass der ausgespielte Content korrekt ist. Da die Kosten für generative KI deutlich sinken, wird es relativ einfach möglich, zusätzliche Modelle für Qualitätssicherung einzusetzen.

Kernaussagen

- Unbegrenzte Varianten statt fester Personas — "Hyperpersonalisierung bedeutet für mich, dass es keine Begrenzung gibt, wie viele Varianten es geben kann." Statt fünf definierte Personas ermöglicht der N=1-Ansatz eine dynamische, individualisierte Kundenansprache.

- Generative KI als Varianten-Maschine — "Das Tolle an generativer KI ist, dass das Erstellen von Varianten deutlich einfacher geworden ist." Wo Menschen nach wenigen kreativen Optionen an Grenzen stoßen, liefert KI nahezu unbegrenzte Varianten.

- Feedback-Loop als absolute Grundlage — "Ich kann so viel individualisieren, wie ich will. Ich weiß halt nicht, ob es funktioniert." Ohne strukturgleiche A/B-Tests und messbares Feedback bleibt Personalisierung Blindflug.

- Foundation Models revolutionieren Forecasting — "Foundation Models für Forecasting haben definitiv das Potenzial, die Art wie Unternehmen Forecasting betreiben, zu revolutionieren." Vortrainierte Modelle übernehmen Feature-Extraktion und Tuning automatisch.

- Personas limitieren, Hyperpersonalisierung befreit — "Wenn ich von vornherein fünf definierte Personas habe, dann habe ich diese fünf Varianten. Bei Hyperpersonalisierung gibt es keine Begrenzung." Der Schlüssel liegt in der dynamischen Varianz.

Fazit und Takeaways

Für Unternehmen, die Hyperpersonalisierung umsetzen wollen

- Dateninfrastruktur vor Technologie: A/B-Testing-Framework und strukturgleiche Kundengruppen sind wichtiger als das neueste LLM – ohne Feedback-Loop ist Hyperpersonalisierung zwecklos

- Geschäftsproblem vor Lösung: Freenets 25 Tarife wurden vom vermeintlichen Problem zur Chance für bessere Personalisierung durch konsequente Kundenorientierung

- Start bei Bestandskunden: Dort sind mehr Daten verfügbar und die Erfolgswahrscheinlichkeit höher als bei anonymen Besuchern

- Datensparsamkeit überwinden: Weiche Parameter erfassen – nicht nur "Kunde X hat Y gekauft", sondern auch "wie viele Kunden haben Y gesehen und nicht gekauft"

Für Data Science und KI-Teams

- Methodenübergreifende Teams statt Silos: Organisation nach Geschäftsbereichen, nicht nach Technologie – jedes Team beherrscht den vollen Methodenbaukasten

- Evolution statt Revolution: Human-in-the-Loop bleibt essentiell, besonders bei externen Kommunikationen – im ersten Schritt steigen oft sogar die Aufwände

- Metaprompting nutzen: Iterative Prompt-Optimierung durch LLMs selbst bringt messbar bessere Ergebnisse

- Skalierung durch Struktur: Von 2 auf 16 Data Scientists durch geschäftsbereichsorientierte Teams statt methodenorientierte Organisation

Für technische Entscheider

- Foundation Models für Forecasting: Modelle wie TAB-PFN können Geschäftszahlenvorhersage revolutionieren, besonders bei kleineren Datenmengen

- Unstrukturierte Daten aktivieren: LLMs ermöglichen es, jahrelang liegengebliebene Freitexte zu klassifizieren und in ML-Modelle zu integrieren

- Open-Source-Transkription: Bessere Qualität zu geringeren Kosten als Cloud-Services durch eigene GPU-Infrastruktur

- Wissensdatenbanken kuratieren: Single Point of Truth mit Historisierung ist Grundvoraussetzung für erfolgreiche Kundenservice-Automatisierung

Diese Episode zeigt eindrucksvoll: Erfolgreiche Hyperpersonalisierung ist weit mehr als Content-Generierung. Sie erfordert eine solide Dateninfrastruktur, klare Geschäftsziele, strukturierte A/B-Tests und die Bereitschaft, schrittweise zu skalieren. Die generative KI ist dabei nur die Spitze des Eisbergs – das eigentliche Fundament liegt in den Daten und Prozessen darunter.